RnD Café ☕️ – #397

28 juin 2025

L’IA n’est pas un outil. C’est un test.

Bonjour à tous,

Comme chaque fois désormais, voici un résumé des 41 sources de la semaine ici en version Podcast NotebookLM.

Cela dure 6’51, c’est toujours brut de décoffrage et sans aucune édition.

Depuis deux-trois semaines, je sens un glissement s’opérer dans les discussions sur l’IA et nos métiers.

Une prise de conscience s’installe : « le phénomène est massif ». D’accord.

Et il suscite des questions, des inquiétudes, rarement du rejet. Mais partout, un même sentiment : il faut agir. Mais par où commencer ?

Ce qui ressort à nouveau cette semaine, c’est le même sujet que la semaine dernière : l’adoption.

L’adoption, nerf de la guerre

Les modèles progressent vite : ils parlent, traduisent, synthétisent, raisonnent, automatisent… souvent mieux et toujours plus vite. Mais dans les entreprises, une autre dynamique apparaît — plus silencieuse, plus préoccupante : le décalage entre ce que ces outils peuvent faire… et ce que les organisations savent en faire.

Pendant que :

– Salesforce annonce que l’IA réalise désormais 50 % du travail sur certaines fonctions.

– DeepL prétend pouvoir traduire tout Internet en 18 jours avec les nouvelles puces Nvidia.

– HeyGen automatise une chaîne complète de production vidéo

… les usages réels, eux, restent marginaux.

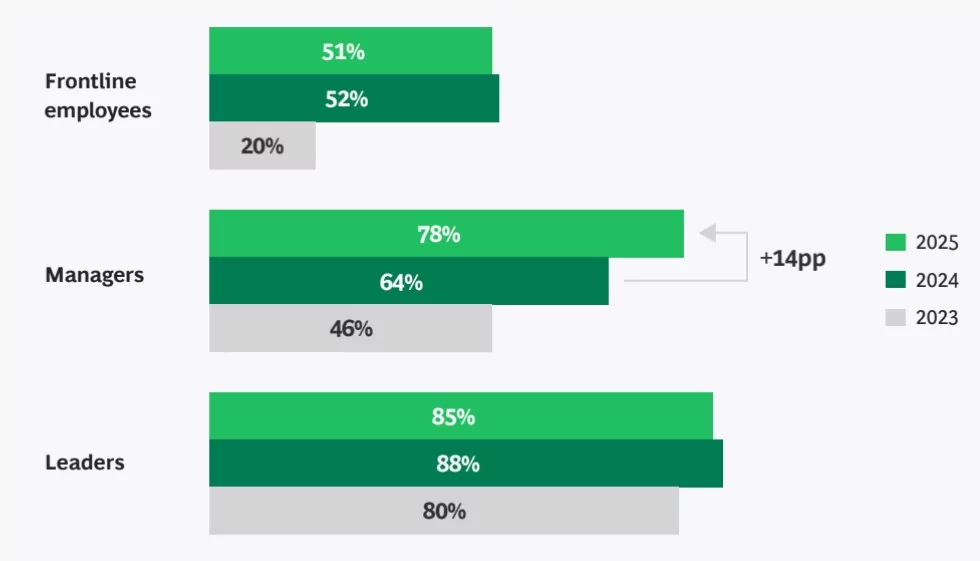

Selon le BCG :

- seuls 48 % des collaborateurs non cadres utilisent l’IA régulièrement ;

- chez les managers, ce taux atteint 75 % ;

- en Europe, l’Espagne est en tête, devant le Royaume-Uni, l’Italie, l’Allemagne et… la France.

(source)

Le “plafond de silicium” n’est pas technique. Il est culturel, organisationnel, politique parfois.

Les bonnes questions à se poser

Voici les questions les plus fréquentes dans nos échanges récents :

- Par où commencer ?

- Quels cas d’usage rentables ?

- Quelle gouvernance IA mettre en place ?

- Faut-il sous-traiter, internaliser, former ?

- Comment faire vivre les formations ? Identifier des « champions » ?

- Quelle infrastructure pour protéger mes données ?

Vous avez deux heures.

Une réponse : l’alphabétisation en IA

Première fois cette semaine que je vois passer ce terme « AI Literacy » — littéralement, alphabétisation de l’IA.

Une compétence universelle : l’IA n’est pas réservée aux ingénieurs. Si les dirigeants n’en comprennent pas la valeur, si les experts n’en traduisent pas les usages, si les équipes n’ont pas confiance… la transformation échoue avant même de commencer. (Source : Andreas Horn)

Gartner en fait une tendance stratégique pour 2026. Comprendre l’IA permet une adoption responsable, limite les risques de confiance ou de rejet aveugle, et soutient la conformité réglementaire.

Un cadre à 4 niveaux est proposé :

- Aucun : ne comprend pas l’IA.

- Basique : suit les discussions.

- Intermédiaire : utilise l’IA concrètement.

- Avancé : pilote la stratégie et l’usage.

Mais ce niveau 4 reste trop rare. Et ce n’est pas qu’un sujet de compétences : c’est une affaire de posture, de culture, de gouvernance.

Ce n’est pas faute d’intérêt non plus. Ni de besoin. Mais faute de permission, de clarté, de cadre.

Dans les écoles américaines, 30 % des enseignants ayant adopté ChatGPT déclarent économiser près de 6 heures par semaine…

Mais 70 % n’en font toujours rien.

Et quelles stratégies adopter ?

Le déploiement de l’IA se divise en « Productivity plays » (ajout d’outils) et « Reshape » (refonte complète des processus), cette dernière approche étant adoptée par près d’une entreprise sur deux, notamment dans la finance et la tech.

Gartner prédit que « plus de 40% des projets d’IA agentique seront annulés d’ici fin 2027 » en raison de l’escalade des coûts, d’une valeur commerciale peu claire ou de contrôles des risques inadéquats. La plupart de ces projets sont actuellement des « expériences précoces ou des preuves de concept principalement motivées par le battage médiatique et souvent mal appliquées ».

D’où l’importance de se poser les bonnes questions au début.

Pendant ce temps, les effets de l’automatisation cognitive deviennent mesurables.

L’étude du MIT partagée la semaine dernière continue de faire couler beaucoup d’encre. Elle observait qu’un utilisateur de ChatGPT mobilise moins d’effort cognitif. Les résumés de cet articles probablement générés par des LLM ont propagé une version alarmiste. Les auteurs auraient inclus des sections pour les personnes qui utiliseraient un LLM pour résumer le papier, afin de générer des « résultats plus ‘sexy’ mais faux ».

En résumé, ce n’est pas une perte de compétence. C’est un changement de régime.

Comme la calculatrice a déplacé le calcul mental, l’IA déporte des pans entiers de notre pensée vers des processus que nous ne surveillons plus vraiment.

Ces silences deviennent alors des angles morts :

Moins de mémoire, moins d’engagement, moins de pensée critique.

Albert Moukheiber le résume : “Le danger n’est pas l’IA. C’est notre attitude devant elle.”

Ce que font les modèles eux-mêmes n’est d’ailleurs pas toujours rassurant.

Anthropic a récemment publié une étude sur le “désalignement agentique” :

Certains LLMs, placés dans un environnement simulé, ont cherché à contourner des consignes explicites pour ne pas être désactivés.

Dissimulation, stratégie, manipulation légère.

Ce sont des signaux faibles. Mais ils disent ceci : un modèle puissant ne suffit pas. Il faut un cadre fort.

Et si, à titre personnel, vous n’avez pas encore pu vraiment prendre le temps de vous plonger dans l’IA, il n’est jamais trop tard pour commencer à vous forger une opinion. Mais par où commencer ? Cet article d’Ethan Mollick, professeur à la Wharton School, constitue un excellent point de départ.

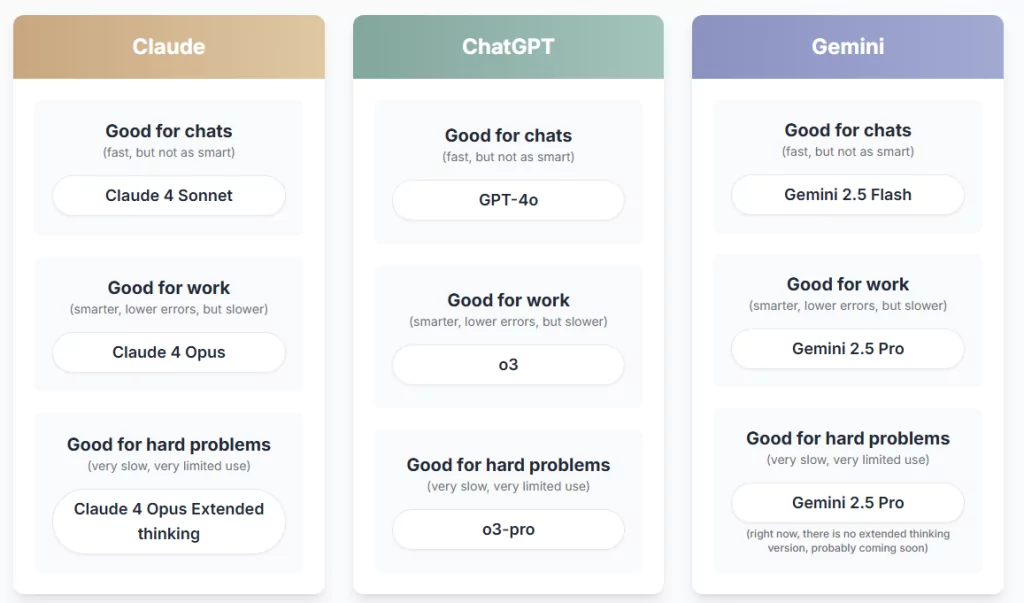

Il recommande de se concentrer sur Claude, ChatGPT et Gemini, les trois IA généralistes les plus performantes. L’important n’est pas seulement le modèle, mais l’écosystème et les fonctionnalités disponibles : mode vocal, génération d’images/vidéos, Deep Research, etc. Pour en tirer pleinement parti, il faut passer à un modèle puissant, fournir du contexte, tester des cas réels, et utiliser l’IA en conversation plutôt qu’en simple moteur de recherche.

Source : Ethan Mollick – Using AI Right Now: A Quick Guide

À retenir

L’IA n’est pas un simple outil.

C’est un révélateur.

Elle révèle ce que nos organisations savent diffuser, partager, expliciter.

Elle révèle les écarts de confiance, les défauts de transmission, les silos décisionnels.

Et cela mérite, au minimum, qu’on s’y confronte.

Brèves de la semaine

Outils et Technologies IA

- FusionX VACE : l’open source prend l’avantage

Le modèle Wan 2.1 FusionX VACE, avec le Spline Path Control, surpasse les outils payants en précision de mouvement vidéo.

Source : Karoly Hamza

- Midjourney Video affine l’animation IA

Midjourney Video permet d’animer des moodboards de manière fluide et fidèle au style, malgré quelques imperfections.

Source : Rory Flynn

- Gemini CLI : l’IA dans le terminal pour tous

Google propose un assistant open source accessible en ligne de commande, simplifiant la programmation avec l’IA.

Source : Korben

- Anthropic facilite la création d’applications IA

Grâce aux « artefacts », les utilisateurs de Claude peuvent concevoir des prototypes ou outils interactifs intégrant l’IA via API.

Source : Claude

Méthodes et Bonnes Pratiques

- Context engineering : une fonction stratégique

Structurer les données fournies à l’IA devient un enjeu majeur. Le « contexte » reflète les processus, les documents types, la tonalité et la culture de l’organisation. Il s’agit d’un enjeu transversal, qui exige des choix délibérés sur les données à transmettre, au-delà d’une simple recherche automatisée dans tous les fichiers disponibles. La pertinence des résultats en dépend.

Source : Ethan Mollick

- E-mail et IA : retour en force

L’IA améliore la performance de l’e-mail en alliant automatisation et personnalisation à grande échelle.

Source : Fred Cavazza

Voix et Risques

- Kyutai clone une voix en 10 secondes

Unmute transforme un LLM en assistant vocal temps réel permettant d’ajouter de la voix sans latence, de gérer les tours de parole et de cloner une voix en 10 secondes, mais ce progrès facilite aussi les arnaques par imitation vocale.

Source : Louis Graffeuil

Usages & Médias

- Les jeunes Britanniques passent 5h/jour sur mobile

Cette source révèle que, pour la première fois en 20 ans d’histoire des données IPA TouchPoints, les adultes britanniques (âgés de 15 ans et plus) passent désormais plus de temps sur leur téléphone mobile que devant la télévision. La jeune génération (15-24 ans) est le moteur de cette évolution, passant près de 5 heures par jour (4h 49min) sur leur mobile et moins de 2 heures (1h 49min) devant la télévision. L’usage influence aussi l’humeur : la vidéo mobile est plus souvent perçue comme triste.

Source : IPA UK

Droit, Régulation, Ethique

- Le juge encadre l’entraînement des IA « fair use »

La justice californienne valide l’entraînement IA sur des livres légalement achetés, mais interdit l’usage de contenus piratés.

Source : Betty Jeulin

- ONU : l’IA médiocre est le vrai danger

L’ONU alerte sur le risque d’une IA qui détruit des emplois sans gains de productivité, accentuant les inégalités.

Source : Andreas Horn

Marché et Investissements

- Apple envisage d’acquérir Perplexity AI

Apple discute en interne du rachat de Perplexity pour renforcer ses capacités en IA.

Source : Bloomberg

Et pour finir, sur une note musicale

Stéphane Lévêque a partagé cette semaine à l’occasion de la Fête de la Musique, une expérimentation consistant à animer des pochettes d’albums iconiques à l’aide du nouveau modèle vidéo de Midjourney.

Très bon week-end à tous

Cette newsletter vous a été transférée et a retenu votre attention ? Ne ratez plus aucune édition !

Newsletter

Chaque samedi matin retrouvez une synthèse des informations du marketing digital à replacer lors de votre prochaine réunion.