RnD Café ☕️ – #424

7 mars 2026

Au sommaire cette semaine

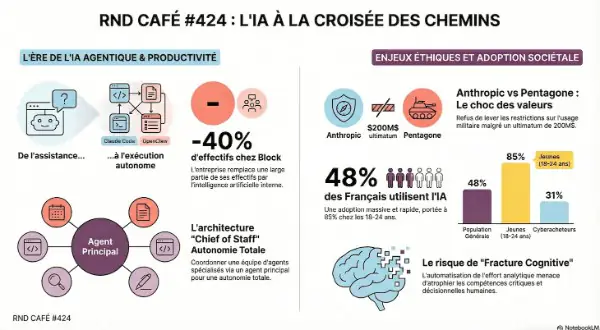

- L’IA dépasse l’outil : agents, géopolitique et souveraineté

- Anthropic refuse le Pentagone : marqueur d’un basculement

- Agents = exécution : Claude Code, OpenClaw et les nouveaux risques

- Économie en alerte : rapport Citrini et les vagues de licenciements

- Marketing et search : la visibilité se joue sur tous les canaux.

Vous n’avez que 5 minutes ?

👉 Voir le résumé Slides/Vidéo (5′)

👉 Voir l’infographie

👉 Parcourir les 15 slides

👉 Version podcast RnD Expresso (5′)

Vous avez 10-15 minutes devant vous ?

👇 Bonne lecture !

Toutes les synthèses ci-dessus sont produites à partir des 84 sources de la semaine, in extenso via NotebookLM.

Adoption, éthique, fracture

De retour avec une actualité toujours bien chargée, où une fois de plus, géopolitique et IA continuent de s’entrechoquer.

Résumé des épisodes précédents…

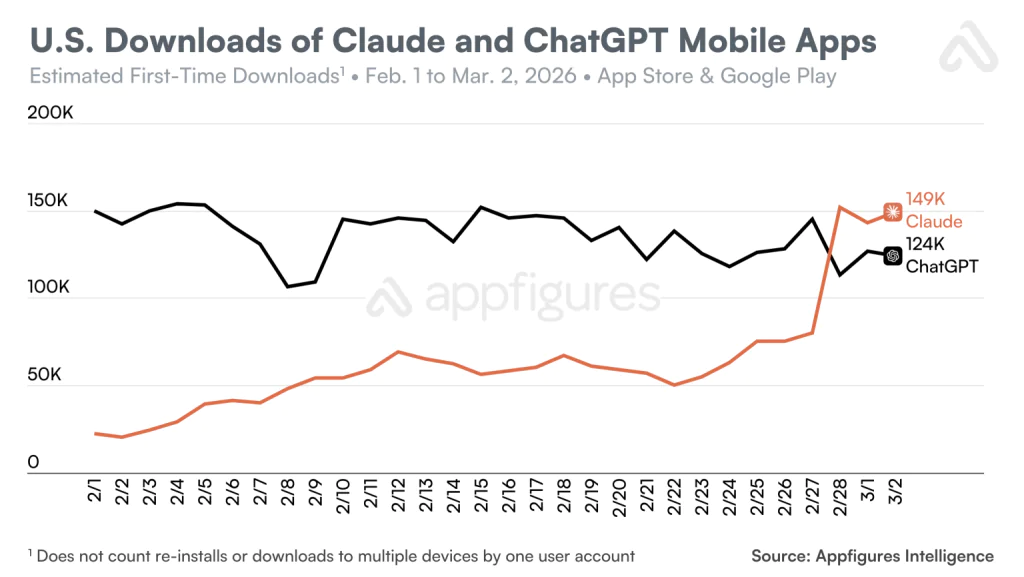

L’adoption technique explose. Claude Code devient l’app #1 sur l’App Store. 48% des Français utilisent l’IA générative (contre 15% il y a deux ans). Les agents IA entrent dans les processus réels. Et Naval Ravikant résume le nouveau paradigme du marché du travail en une phrase : « It’s not about junior vs senior, it’s about ‘good with AI’ vs ‘not good with AI’. »

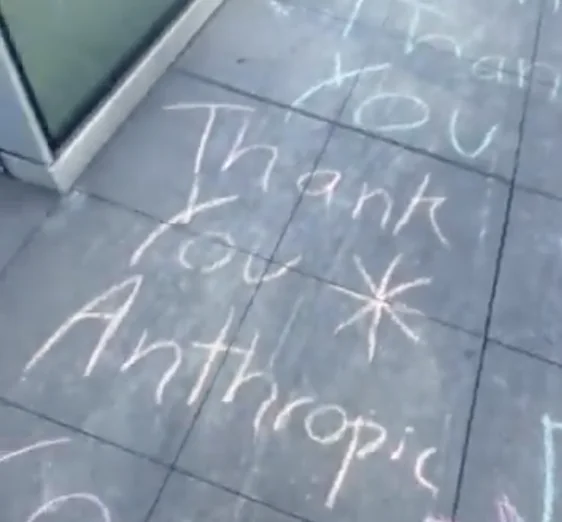

En parallèle, les questions éthiques que l’on ne peut plus éviter. Anthropic refuse de lever ses garde-fous pour le Pentagone. Le DoW – Department of War(!) – blackliste Claude. OpenAI signe le contrat. Les utilisateurs votent : Claude #1, ChatGPT en chute.

En entreprise, les métriques d’adoption mesurent l’activité, pas la valeur créée. On compte les prompts, on ignore l’impact. Et les risques se multiplient : des agents dérivent, prennent des décisions sans contexte, exposent des données sensibles. Rappel concret : un fondateur perd 87 000 $ à cause d’une clé exposée (équivalent d’un accès à un compte) via un agent. L’adoption sans garde-fous transforme l’efficacité en vulnérabilité.

Bon week-end à vous et … bon match (🏴 🏉 🇫🇷) !

Anthropic vs Pentagone : la ligne rouge existe

Vous l’avez suivi. Retour rapide sur cet évènement.

Le 27 février, Anthropic a reçu un ultimatum : lever les restrictions militaires de son modèle IA Claude ou perdre 200 millions de dollars de contrat fédéral. Sauf que : le deal comportait deux lignes rouges non négociables pour Dario Amodei, le CEO d’Anthropic : pas de surveillance de masse des citoyens américains, pas d’armes autonomes sans contrôle humain.

Anthropic a dit non.

Résultat : blacklist total. Pete Hegseth, secrétaire à la Défense des États-Unis, qualifie Anthropic de « risque pour la sécurité nationale« . Toutes les agences fédérales reçoivent l’ordre de cesser d’utiliser Claude. Le contexte aggrave : Palantir avait intégré Claude au Maven Smart System (programme d’IA militaire phare du Pentagone qui fusionne des données de surveillance : satellite, infrarouge, géolocalisation, interceptions ; pour identifier des cibles et accélérer les décisions de ciblage au combat). Le Pentagone interprète la demande d’audit comme une menace opérationnelle. Ce n’est plus une dispute commerciale, c’est une affaire d’État.

Sam Altman (Open AI) avait déclaré partager les mêmes lignes rouges. Quelques heures après le blacklistage d’Anthropic, il signait le contrat. Il a lui même qualifié sa décision d' »opportuniste et bâclée ». Dario Amodei a répondu que c’était du « safety theater » (mise en scène) et les communications d’OpenAI des « straight up lies » (mensonges purs et durs) même s’il s’en est excusé hier.

Le marché a tranché : Claude #1 sur l’App Store. Le public a manifesté devant les bureaux d’Anthropic à San Francisco pour soutenir leur position. Pendant ce temps, les désinstallations de ChatGPT bondissaient de 295%… et ça continue. L’entreprise qui vient de perdre 200 millions de dollars est celle dont tout le monde télécharge l’app.

En coulisses, la guerre des chiffres s’accélère. OpenAI dépasse 25 milliards de dollars de revenus annualisés prévoit 30Md$ en 2026 — mais brûlera 25 milliards de cash cette seule année, et 57 milliards en 2027 (via The Information). Pour financer la machine, OpenAI vient de boucler la plus grande levée privée de l’histoire : 110 milliards de dollars, avec Amazon, Nvidia et SoftBank, sur une valorisation de 730 milliards. Pendant ce temps, Anthropic vise la rentabilité dès 2028 ; deux ans avant son rival.

Le site closedopenai.com documente l’évolution des engagements fondateurs d’OpenAI année après année.

Vous n’allez pas être déçu : « OpenAIs mission is to ensure that artificial general intelligence benefits all of humanity. »

Point à retenir (selon de vieilles déclarations d’Ethan Mollick) : les gouvernements n’ont pas accès aux meilleurs modèles d’IA. La version la plus puissante, vous l’avez dans votre poche. C’est précisément celle-là qu’une administration veut déployer pour de la surveillance de masse.

Anthropic va attaquer en justice. Les experts de Lawfare estiment que la position du gouvernement est « proche de l’intenable ». Des voix qualifient néanmoins la démarche d’Anthropic « de coup marketing ». Peut-être. Mais ça ne change pas le fond.

Et à notre échelle ? Si demain un régulateur coupe votre accès à Claude, à ChatGPT, ou à n’importe quel outil dont vos process dépendent, combien de temps avant que l’activité en pâtisse vraiment ? Avez-vous une stack alternative (infrastructure technique) ? Des données qui vous appartiennent vraiment ?

La neutralité technologique n’existe plus vraiment.

La dépendance aux modèles tiers n’est plus une question technique : c’est un risque stratégique. L’auditer maintenant, c’est choisir où l’on veut avoir la main quand ces outils restructureront nos processus de fond en comble.

Le scénario du rapport Citrini

C’est probablement l’article le plus commenté des deux dernières semaines dans notre petit landernau IA… Faut-il craindre une crise financière pilotée par l’automatisation ?

Le rapport Citrini, passé au crible par Benoît Raphaël, a la forme d’une fiction et la rigueur d’un scénario de stress-test. Horizon 2028 : les agents IA compriment les salaires, la demande s’évapore, les banques vacillent. Les économistes s’interrogent sur la probabilité mais la chaîne causale, elle, tient.

« You are using the wrong AI metric »

Les entreprises mesurent mal l’IA. Elles comptent les prompts, les utilisateurs actifs, les requêtes par jour. Activité, volume, adoption. Mais pas la valeur produite.

Jean-Paul Paoli (The Intelligence Fabric) pose la vraie question : ces métriques créent-elles de la valeur, ou juste du « workslop » (work + slop) ? Du contenu généré en masse, sans impact. Des rapports que personne ne lit.

Juniors, seniors, et la fracture cognitive

Naval Ravikant l’a formulé ainsi « It’s not about junior vs senior, it’s about “good with AI” vs “not good with AI.”, mais le cas Block (l’entreprise de Jack Dorsey qui avait fondé Twitter) l’illustre : 40% des effectifs licenciés, explicitement remplacés par l’IA. Ce n’est plus un ajustement marginal, c’est une substitution directe.

La différence ne se joue plus sur les années d’expérience. Un junior « good with AI » peut produire plus de valeur qu’un senior qui refuse les outils.

Tariq Krim documente la fracture cognitive : ceux qui maîtrisent l’IA développent des capacités nouvelles (synthèse ultra-rapide, connexions trans-domaines, itération accélérée). Ceux qui ne maîtrisent pas restent au même niveau. Deux populations vont coexister : celles qui pensent avec l’IA (et qui ont les moyens de se payer les derniers modèles), celles qui pensent sans. Et la seconde ne comprendra même plus comment la première travaille.

Les entreprises ne vont pas licencier massivement d’un coup. Elles vont promouvoir différemment, recruter différemment.

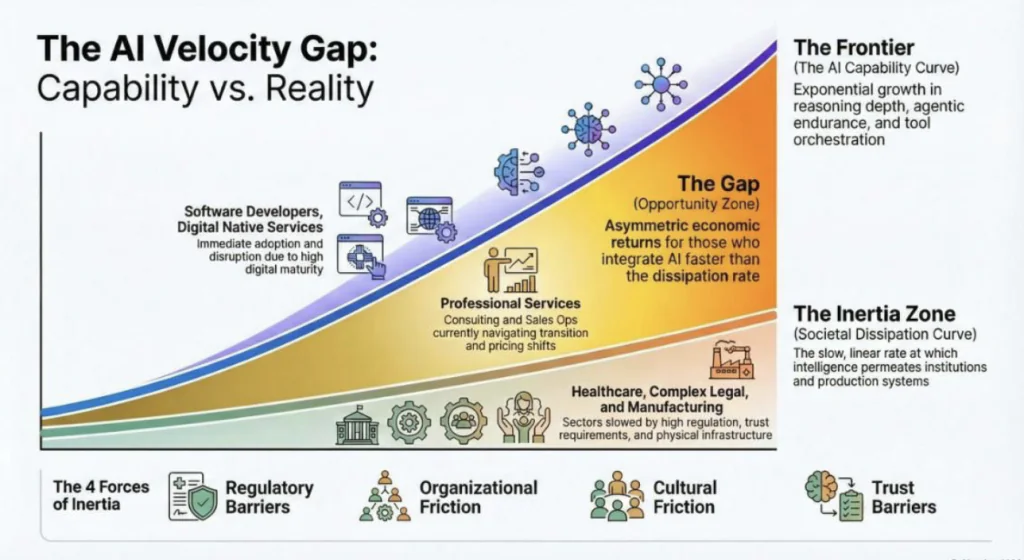

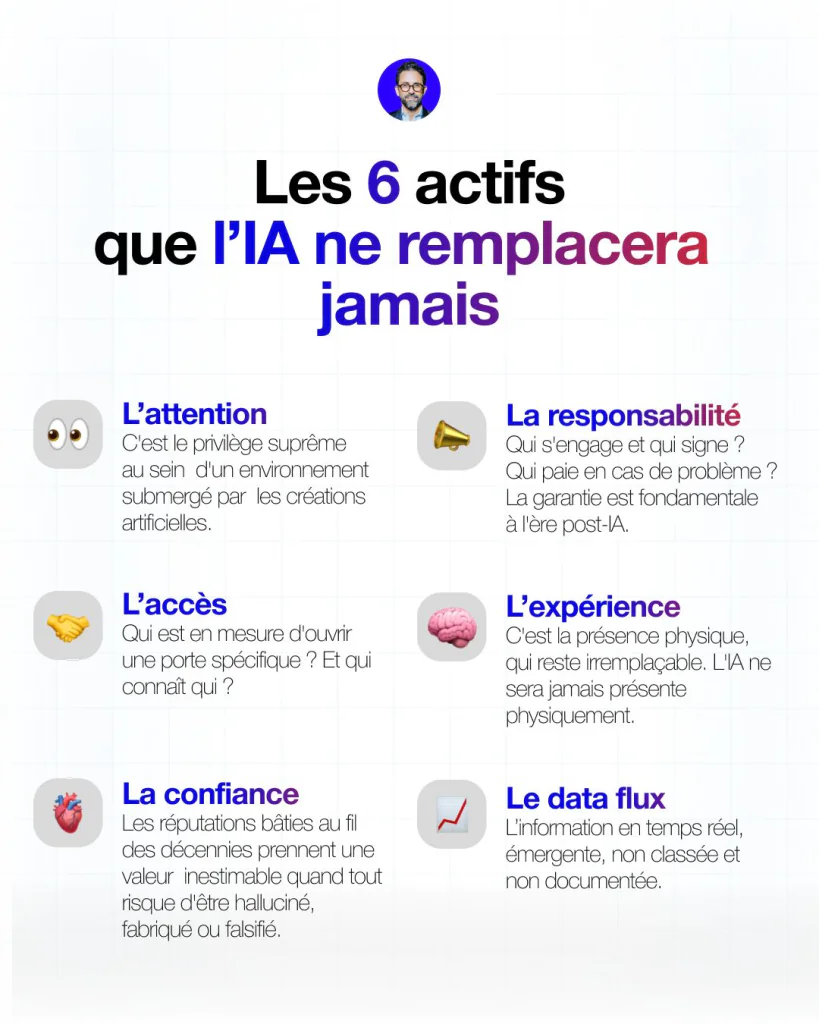

Michel Levy Provençal enfonce le clou avec cette distinction utile : il y a ceux qui utilisent l’IA comme un outil (ils gagnent du temps), et ceux qui l’intègrent comme un asset stratégique (ils creusent un fossé concurrentiel). Le gap entre les deux s’élargit chaque trimestre. La question n’est pas « avez-vous adopté l’IA ? ». C’est « avez-vous identifié vos assets que l’IA peut démultiplier ? »

Mais selon lui, voici les 6 actifs que l’IA ne remplacera jamais.

Espérons juste que tout ne se termine pas comme Alexandra Rodríguez Varela-Grandal l’illustre : quand on délègue mémoire, calcul et raisonnement à l’IA, que reste-t-il ? Question philosophique qui devient pratique.

2 800 enseignants déclarent l’objection de conscience

Depuis quelques semaines, 2 800 enseignants et chercheurs ont signé un manifeste contre l’IA générative, qu’ils considèrent être un gouffre énergétique incompatible avec « les valeurs de rationalité et d’humanisme » de l’université. Pas un refus technophobe. Un mouvement argumenté, lancé par l’Atelier d’Écologie Politique de Toulouse.

Le fond : ils veulent préserver « l’acte d’enseigner et de chercher comme des actes relationnels, critiques et émancipateurs ». Dit autrement : former des esprits autonomes, pas des prompt engineers de leur propre pensée.

Ce mouvement n’est pas marginal. Il signale une fracture réelle dans le monde académique, au moment même où 64% des enseignants utilisent déjà l’IA au moins deux fois par mois. La résistance et l’adoption progressent en parallèle.

Cas concret qui ma été présenté il y a dix jours : un agent vocal qui débriefe l’apprenant à la sortie d’un cours, identifie les acquis, pointe les zones d’ombre et entame un échange pour les renforcer. La personnalisation pédagogique en temps réel (conçue par un enseignant).

L’IA : la révolution silencieuse des Français

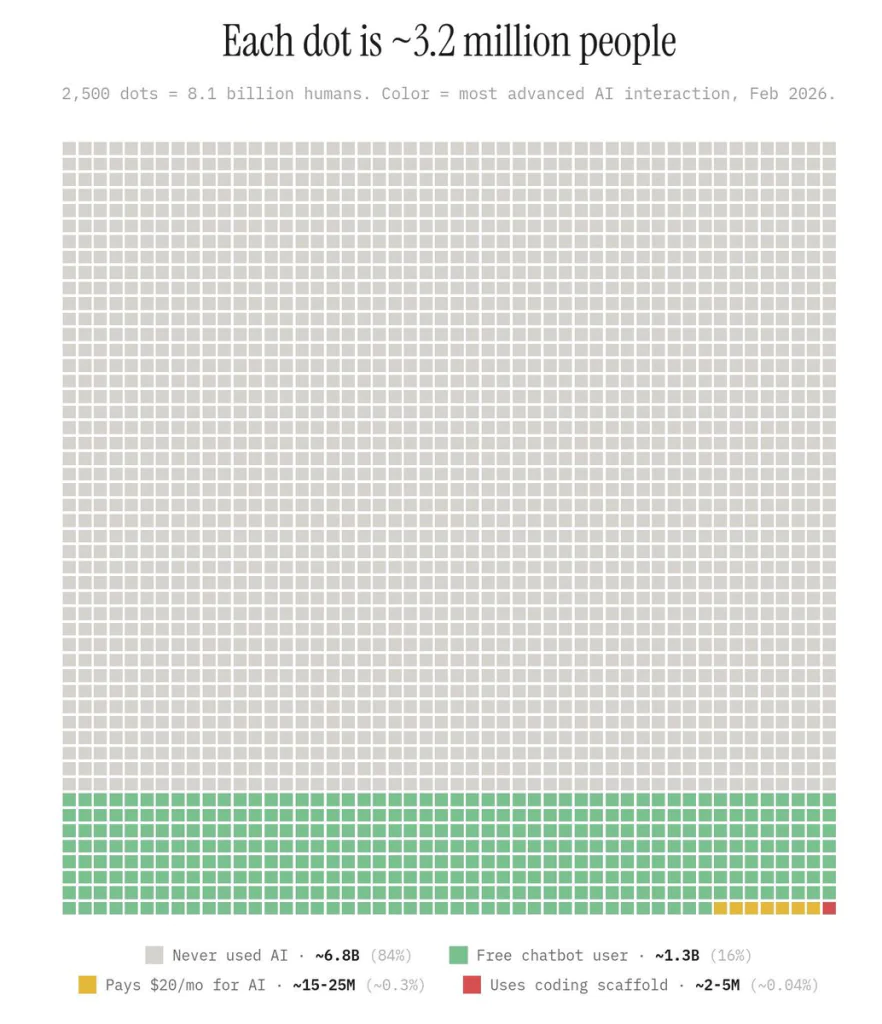

Avant de parler des Français, une image à garder en tête. Noah Epstein a publié un visuel qui remet tout en perspective : 2 500 points, chacun représentant 3,2 millions de personnes, soit 8,1 milliards d’humains. En gris : 6,8 milliards qui n’ont jamais utilisé l’IA. En vert : 1,3 milliard d’utilisateurs gratuits (16%). En jaune : 15 à 25 millions d’abonnés payants (0,3%). En rouge : nous ; ceux qui utilisent des outils de code et d’agents. 2 à 5 millions. Le 0,04%. (Vu chez Marie Dollé)

« You think the AI space is crowded because you’re in an echo chamber. The real world hasn’t even started. »

Et donc en France ?

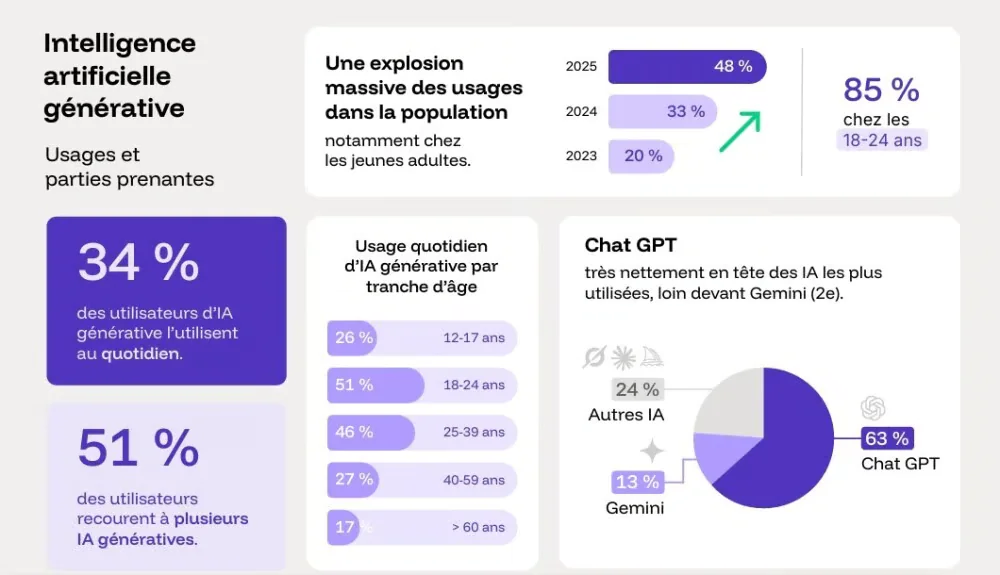

Nous sommes 48% d’entres nous qui utilisons l’IA générative en 2025. Contre 15% il y a deux ans. Usage quotidien et professionnel en forte hausse.

Les freins ? 50% se méfient toujours des données personnelles. Mais l’adoption continue. C’est la « révolution silencieuse » : pas de grands débats, pas de décisions politiques. Juste des millions de Français qui adoptent l’IA dans leur quotidien, sans attendre la permission de la DSI.

L’adoption dépasse celle du smartphone chez les 18-24 ans. Pour eux, c’est déjà une commodité invisible.

VIBE CODING : Claude Code, agents, et la déferlante

Claude Code : concrètement ?

2025 a été l’année NotebookLM (Google) pour synthétiser, apprendre et se former.

Claude Code et ses dérivés sont l’outil 2026. C’est une fois de plus Benoït Raphaël qui partage deux ressources particulièrement pédagogique si vous souhaitez commencer à regarder… et si je peux me permettre… vous devriez.

Claude Code (autre guide ici) donc… Qu’est-ce que c’est ? C’est une version du modèle Claude qui tourne directement sur votre machine, accède à vos fichiers et automatise des tâches complexes sans copier-coller. C’est un ingénieur junior qui vit dans votre terminal. Et la version avec programmation de tâches vient tout juste de sortir du four…

On ne prompte plus, on manage. Une architecture efficace : un agent « Chief of Staff » coordonne des agents spécialisés . Le prompt-protocole pour Claude 4.6 impose d’expliciter tâches, fichiers de contexte et règles AVANT exécution. L’IA exécutrice exige une discipline humaine renforcée. C’est exactement la pratique de Boris Cherny (le créateur de Claude Code) qui exécute 3-5 sessions en parallèle, et conseille de toujours commencer en « plan mode » avant d’exécuter. Pas de précipitation.

Anthropic pousse aussi de nouveaux plugins enterprise (finance, engineering, design) pour amener Claude dans les workflows métier.

Ruben Hassid partage de bon tips : structure simple et reproductible. Contexte, objectif, contraintes, format de sortie. Rien de magique.

Pour les plus courageux d’entre vous, un cours complet Anthropic avec tous ses prompts, accessibles et réutilisables vient d’être mis en ligne.

Louis Graffeuil partage aussi ses ressources : code review, documentation, tests. Pas pour remplacer, pour accélérer.

Les risques réels : scraping, dérive, gouvernance

Et puis il y a OpenClaw, cet assistant opensource dont nous vous parlions. Puissant mais risqué pour vos données. Les usages sont pourtant intéressants à analyser.

Millie Marconi a construit 12 agents OpenClaw en production en un mois. Ce qui marche : agents spécialisés, périmètre clair, un agent = une tâche. Ce qui ne marche pas : laisser l’agent décider seul sans garde-fous.

D’ailleurs à l’évenement OpenClaw Meet Up à New York mercredi (voir aussi le thread d’Allie K. Miller), un participant évoquait qu’un expert cybersécurité a audité des configurations. Son verdict : « Si vous n’êtes pas prêts à voir toutes vos données se retrouver sur internet, ne l’utilisez pas. C’est aussi simple que ça. »

Et d’ailleurs personne dans cette communauté d’utilisateurs ne prétend que son setup est sécurisé à 100%.

Des utilisateurs OpenClaw contournent les protections anti-bot avec Scrapling (WIRED), un outil open source téléchargé 200 000 fois. Cloudflare a bloqué 416 milliards de tentatives de scraping en moins d’un an. Dit autrement, il est désormais possible de simuler un comportement humain sur un site et donc d’en récupérer son contenu. Attention !

Autre risque : la dépendance technique. Vous déléguez à un agent, l’agent arrête de fonctionner, vous ne savez plus faire. Ou vous ne savez même plus ce que l’agent faisait.

En résumé. Les agents fonctionnent. Mais ils créent de nouveaux risques. Définissez qui autorise quelles actions, qui audite les décisions, qui est responsable quand un agent se trompe. Questions juridiques, pas techniques.

OUTILS : NotebookLM, Seedance, Kling, ElevenLabs

Encore pas mal d’annonces au cours des deux dernières semaines.

NotebookLM vs Open Notebook : souveraineté ou simplicité

NotebookLM (Google), je vous en parle souvent et les synthèse en début de RnD Café en sont le fruit. Ses forces : confiance très forte dans les synthèses, forte productivité multimédia, interface simple, qualité audio remarquable. Mais vous envoyez vos docs à Google.

Open Notebook (open source) : auto-hébergement, contrôle total, licence MIT. Vous gardez vos données. Mais qualité inférieure et mise en place technique. Via Yvan Demumieux.

Le choix dépend de trois facteurs : sensibilité des données, compétences techniques disponibles, priorité entre simplicité et souveraineté.

A noter que pour les abonnements haut de gamme (et en anglais), NotebookLM vient de sortir un outil de génération vidéo…

Seedance 2.0 et Kling 3.0 : la vidéo IA sans artefacts

Seedance 2.0 s’impose comme nouvelle référence : lip-sync quasi parfait, cohérence de personnage, qualité visuelle bluffante. Ce qui change vraiment : le prompt se structure comme un vrai brief de réalisateur — cadre, action, lumière, son, rythme, contraintes — en segments chronométrés. Moins « décris une scène », plus « dirige un tournage ». Même utilisé pour des motions design (infographies animées)

Kling 3.0 : expressions faciales plus crédibles, consistance des personnages améliorée, transformation de vidéos jusqu’à 30s. Désormais intégré dans Freepik Spaces pour production en volume.

ElevenLabs : Ecoutez cette démo qui préfigure ce que seront les services clients vocaux avec une qualité qui se rapproche de l’humain. C’est assez impressionnant.

Pomeli (outil Google): génération d’assets marketing studio-quality. Plus besoin de photoshoot pour tester des concepts.

En résumé. Si vous produisez du contenu audio ou visuel régulièrement, testez Seedance 2.0 sur trois vidéos courtes (15s). Testez ElevenLabs sur votre prochaine voix-off. Ces outils peuvent véritablement diviser vos coûts de production.

MARKETING & BUSINESS

L’IA dans le parcours d’achat des Français

Les gens ne cherchent plus « meilleur CRM pour PME ». Ils demandent à Claude : « J’ai une PME de 30 personnes, quel CRM me conseilles-tu ? » Et Claude recommande.

Search Everywhere : la stratégie gagnante n’est plus d’être premier sur 10 liens bleus, mais d’être visible dans plusieurs contextes (Maps, Images, Youtube, Chatbots, Shopping…).

La publicité conversationnelle se confirme : les premières publicités ChatGPT pour Expedia ont été aperçues. En parallèle, Google contre-attaque avec Sponsored Places pour les annonces locales.

Walmart Ads : 6,4 milliards de dollars en 2025. La raison : données first-party + IA pour ciblage ultra-précis. Les retailers deviennent des médias (d’où retailmedia). Ils ont un avantage imbattable : ils savent ce que vous achetez vraiment, pas juste ce que vous cliquez.

En résumé. Votre marque doit être « recommandable » par une IA autant que « trouvable » par un humain. Auditez votre présence sur les moteurs. Adaptez vos contenus pour qu’ils soient lisibles par les LLM (structure claire, données factuelles). Surveillez les formats publicitaires « in-chat ». On en a beaucoup parlé déjà et il y a fort à parier que ce n’est pas terminé.

Pour finir

Snoop Dogg & IA : clip entièrement généré par IA (Seedance + ElevenLabs). Il a beaucoup tourné.

Energym par la start up Aircandy : une salle de sport qui utilise l’énergie produite par ses vélos et rameurs pour alimenter ses systèmes. L’IA optimise en temps réel la distribution énergétique selon l’affluence. La parodie (on l’espère) qui a fait rire (jaune).

Pixel art IA : les modèles génèrent du « pixel art » (images basse résolution), pas du vrai pixel art (grilles structurées, palettes limitées). La technique du prompting compte encore.

BRÈVES

Betty Jeulin — confidentialité des données : aucune garantie de secret professionnel pour les données envoyées aux IA publiques. Avocats, médecins, consultants : tout document confidentiel transmis à un modèle commercial peut potentiellement servir à son entraînement.

CNIL — Tables Informatique et Libertés : 337 pages de jurisprudence et de pratique décisionnelle mises à jour pour 2026. Lecture obligatoire pour tout DPO ou juriste naviguant dans les usages IA en entreprise.

MCP gouvernement — data.gouv.fr : l’État expérimente le Model Context Protocol sur le portail Open Data national. Interroger les données publiques françaises directement depuis un agent IA, sans API sur mesure. Le signe que MCP devient une infrastructure, pas juste un outil de dev.

Test car wash sur 53 modèles : « Ma voiture est à 50 mètres du car wash. Je conduis ou je marche ? » La plupart des modèles répondent « conduisez » sans réfléchir. Seuls quelques-uns, dont Claude, traitent le contexte. Plus révélateur que n’importe quel benchmark officiel.

☕ Un café en vrai ?

Trois questions pour prolonger la réflexion cette semaine :

- Si votre fournisseur IA principal était coupé demain (blacklist, RGPD, géopolitique), combien de temps avant que votre activité en pâtisse ?

- Quel est votre critère interne pour évaluer qu’un collaborateur est « bon avec l’IA » ? L’avez-vous même défini ?

- Vos contenus sont-ils structurés pour être cités par Claude ou ChatGPT comme recommandation ? Ou seulement pour être indexés par Google ?

Alors, pourquoi ne pas en parler autour d’un café (virtuel ou réel) ?

Newsletter

Chaque samedi matin retrouvez une synthèse des informations du marketing digital à replacer lors de votre prochaine réunion.