RnD Café ☕️ – #430

25 avril 2026

Au sommaire cette semaine

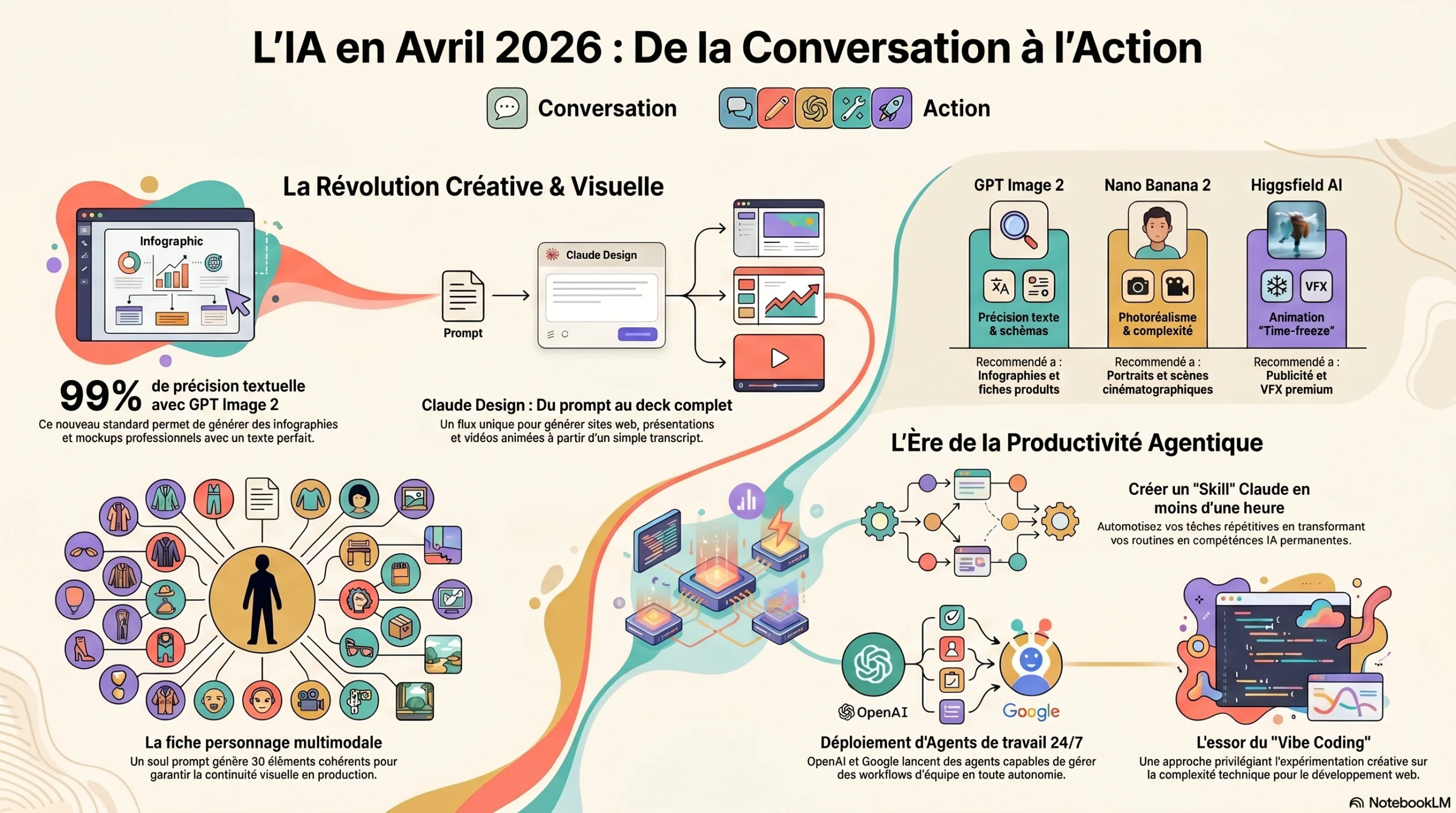

- Agents : ChatGPT s’y met: l’IA ne dort plus

- GPT Image 2.0 : la production visuelle sort de la loterie

- Vibe coding et vibe design : la créativité reprend la main

- Anthropic passe devant OpenAI sur la courbe des revenus

- Le « mode bourré » : un antidote à l’uniformisation IA

Vous n’avez que 5 minutes ?

👉 Voir le résumé Slides/Vidéo (5′)

👉 Voir l’infographie

👉 Parcourir les 15 slides

👉 Version podcast RnD Expresso (5′)

Vous avez 10-15 minutes devant vous ?

👇 Bonne lecture !

Toutes les synthèses ci-dessus sont produites à partir des sources de la semaine, in extenso via NotebookLM.

L’agent travaille, le designer crée

Bonjour à toutes et à tous.

Depuis mi-décembre avec Claude Code, les agents sont passés de démos à outils qui tournent dans des processus réels. La semaine dernière (#429), le constat était posé : ils s’installent, pour le meilleur et pour le pire.

Cette semaine, OpenAI rattrape Anthropic. Les agents ChatGPT workspace tournent 24/7, se partagent entre collègues, s’appuient sur Codex. Et Google suit aussi.

Deux autres signaux convergent.

- D’abord, Anthropic dépasse OpenAI en revenus annualisés (il y a deux ans, personne n’aurait parié un token là-dessus) : le choix Claude sur le code, les agents et la fiabilité paie, malgré les bugs récents et l’inflation des coûts.

- Ensuite, le volume d’inférence (le calcul consommé à chaque requête traitée par un modèle, par opposition à l’entraînement qui se fait en amont) : 16 milliards de tokens par minute sur les API propriétaires (un token équivaut à peu près à un mot). Les agents consomment du calcul à échelle industrielle, et quelqu’un paie la facture.

On passe de l’expérimentation à la gestion.

Qui crée les agents ? Qui les audite ? Qui les arrête ? Qui paie quand ils dérapent ?

On est en plein dedans avec les entreprises que nous accompagnons en formation.

Et en face de cette exécution silencieuse, un contre-mouvement apparaît.

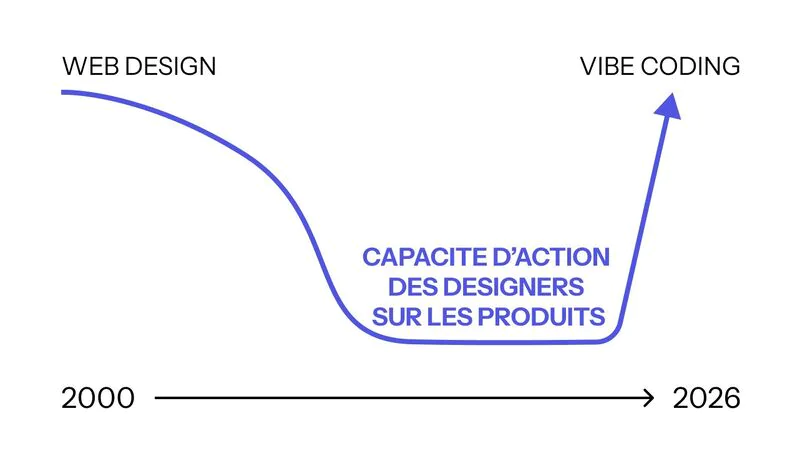

C’est peut-être le signal le plus utile de la semaine. La courbe que partage Étienne Mineur (analyse de David Serrault) retrace 25 ans de créativité web : explosion en 90-2000, chute avec la standardisation, remontée depuis quelques mois.

Le vibe coding ramène de l’expérimentation parce qu’il décharge la technique (mais attention, on en a vraiment besoin ensuite).

Double bascule, donc : l’automatisation s’industrialise (agents, production visuelle, orchestration), pendant que les créatifs récupèrent le terrain perdu.

Mais les mêmes outils produisent aussi du slop (littéralement « bouillie », mot de l’année) : masse de contenus IA techniquement corrects, sans intention. J’en parlais en janvier dans le #417 et au Printemps des Technologies.

GPT Image 2 génère des infographies cohérentes avec votre charte en trois prompts. Claude Design sort un prototype et un « brand system » en deux.

Higgsfield Marketing Studio fait une pub end-to-end.

Opportunité créative et machine à slop : c’est la même techno, elle suit le brief qu’on lui donne.

Cette semaine, quatre angles : l’agentique qui passe à l’échelle, la production visuelle qui sort de l’aléatoire, le retour du vibe design, et les contre-mouvements humanistes.

Bonne lecture.

1. Agents : ChatGPT devient un collègue qui ne dort jamais

On avait vu passer ClawdBot puis Moltbot en janvier (souvenez-vous du #421). Un agent qui prenait le contrôle de votre Mac. Impressionnant, bricolé, troué de failles.

Anthropic a forcé deux renommages pour éviter la confusion avec Claude : l’outil s’appelle maintenant OpenClaw. La communauté s’en est emparée : 135 000 instances actives, 247 000 stars sur GitHub. C’est mieux, même si la vigilance reste de mise.

Anthropic continue de réagir. Depuis le 4 avril, les abonnements Claude Pro et Max ne couvrent plus OpenClaw ni les autres frameworks tiers. Il faut passer par des bundles facturés à part ou une clé API : 10 à 50 fois plus cher pour les gros utilisateurs. Justification officielle : un seul agent OpenClaw peut brûler 5 000 dollars de calcul par jour sur un forfait à 200.

Détail de calendrier : le créateur d’OpenClaw est parti chez OpenAI en février. L’usage a chuté. Plusieurs agents tournent encore chez nous sur OpenClaw et nous avons dû placer un « aiguilleur de tokens » pour orienter vers le modèle le moins onéreux selon la demande.

Agents workspace ChatGPT

Cette semaine, OpenAI a sorti sa version propre et industrielle (et hier GPT 5.5). Les agents workspace ChatGPT tournent 24h/24, sont partageables au sein d’une équipe et s’appuient sur l’architecture Codex. Ce sont des collaborateurs virtuels asynchrones.

Exemples ?

Vous déléguez la veille concurrentielle, le tri de tickets support, la synthèse de réunions, la pré-rédaction de rapports. L’agent travaille pendant que vous faites autre chose. C’est cette persistance qui change la donne. L’IA a un contexte, des missions, un historique. Elle est partageable avec vos collègues. Et elle exécute sans attendre votre feu vert à chaque étape.

Cette bascule a un nom : le passage du synchrone à l’asynchrone.

En management, c’est ce qui distingue un stagiaire qu’on micro-manage d’un salarié autonome. C’est le glissement qu’on est en train d’opérer avec nos IA.

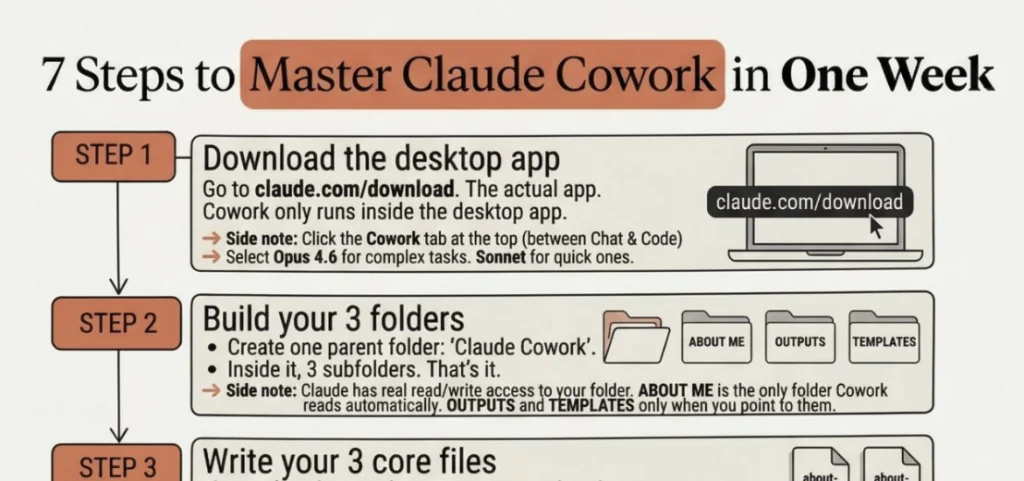

En parallèle, Google sort son propre agent de bureau, Anthropic pousse Claude Opus 4.7 et sa fonction Cowork pour transformer les tableaux de bord en prompts actionnables. Tout le marché bascule vers l’orchestration d’agents.

Côté usage créatif, même idée. Pierrick Chevallier a testé Agent One sur Invideo : en partant d’un brief simple, l’agent orchestre toute la création multimédia (script, visuels, montage, voix). Ce qui demandait une demi-journée en sollicitant plusieurs outils se fait en autonomie.

La question qui tue : qui gère ces agents ?

En matière de gouvernance, ça mérite de se poser quelques minutes.

- Qui a le droit de créer un agent ?

- Qui valide ses accès aux bases de données ?

- Qui audite son historique d’exécution ?

- Qui l’arrête quand il dérive ?

- Qui paie quand il fait une boulette ?

Si la réponse à ces cinq questions est « personne » ou « on verra », alors il faut qu’on parle 😉.

Dès lors qu’un salarié peut créer un agent qui tourne 24/7 avec des accès à vos données, vous avez besoin d’un registre, d’une politique d’accès et d’un protocole d’audit. Comme pour n’importe quel prestataire.

Sans cadrage, ces agents tournent déjà chez vous : non déclarés, non audités.

Et donc ?

- Inventaire : faites la liste des agents utilisés par vos équipes (y compris les « Shadow agents » créés sans validation IT)

- Registre : créez un registre interne avec propriétaire, accès, objectif et date de revue pour chaque agent

- Sandbox : déployez un premier agent workspace sur un cas à faible risque (synthèse de meeting, tri d’emails) avec logs activés

- Gouvernance : définissez qui peut créer, qui doit valider, qui peut arrêter

2. Production visuelle : GPT Image 2.0 sort de la loterie

Le problème avec la génération d’images via IA, c’était le « hasard contrôlé ». Vous lanciez dix prompts pour en garder un. Les textes étaient illisibles. Les personnages changeaient de visage d’une image à l’autre. La charte graphique, mieux valait ne pas y penser. Avec Nano Banana (Google) fin août 2025, les choses ont commencé à bouger. On parlait de cohérence.

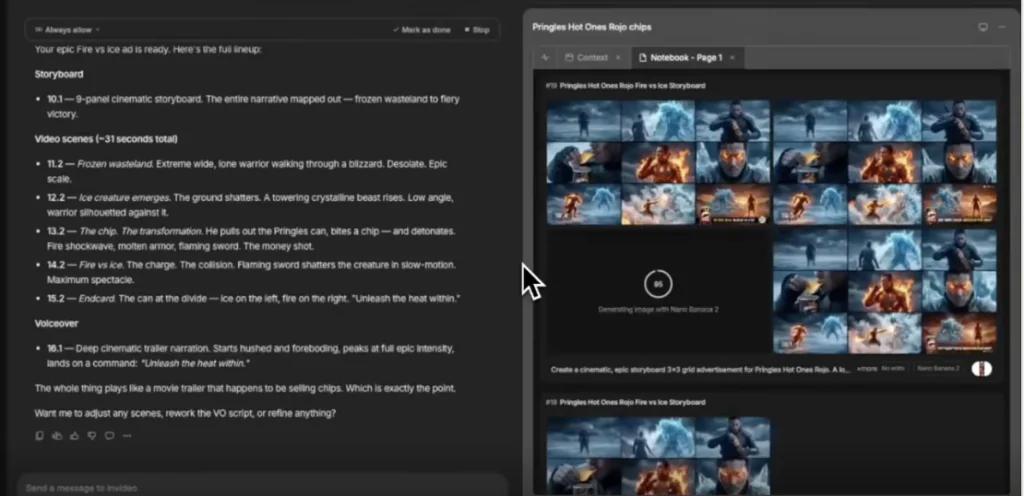

Cette semaine, OpenAI (éditeur de ChatGPT) revient sur le devant de la scène et semble même passer devant Google avec GPT Image 2.0.

Précision textuelle, cohérence de charte, mode « Thinking »

Ce qui change concrètement :

Comme le détaille Axelle Malek, le nouveau modèle atteint une précision textuelle sur les visuels qui rend les mockups enfin utilisables. Lettres lisibles, typographies respectées, diagrammes exploitables.

Sur le plan de la production terrain, Marie Robin a testé GPT Image 2 pour générer des infographies conformes à une charte stricte, en partant d’un rapport VML et d’une URL. Résultat : des visuels prêts à intégrer. C’est le genre de travail qui occupait des cellules de studio entières.

Gilles Guerraz met l’accent sur le mode « Thinking » : avant de générer, le modèle raisonne, vérifie des informations sur le web, planifie sa structure visuelle. Il sort jusqu’à 8 déclinaisons cohérentes. On est passé de « génère-moi une image » à « organise-moi une série de visuels qui tient debout ».

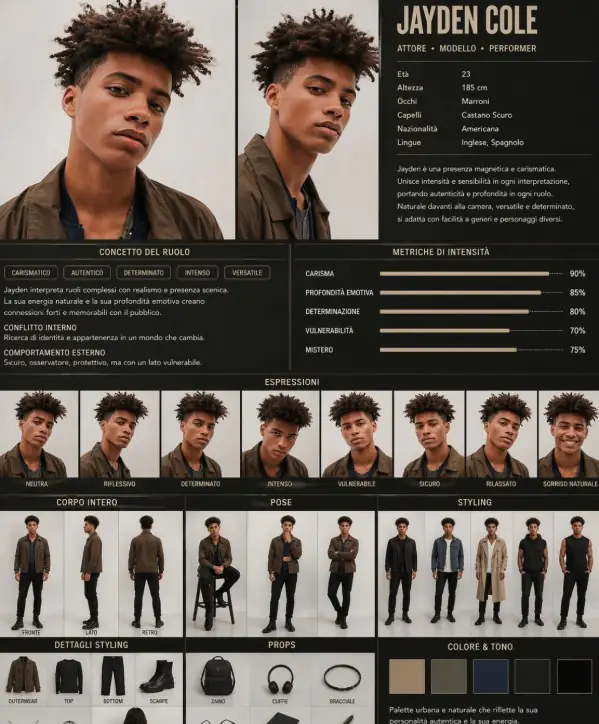

Paolo Gavazza va plus loin : un seul prompt génère une fiche personnage multimodale avec 30 éléments cohérents. La pré-production de films, de jeux, de contenus sérialisés passe du mois à la journée.

Le match GPT Image 2 vs Nano Banana 2

Nate Herkelman a comparé les deux. Verdict nuancé : GPT Image 2 domine sur texte, schémas, cohérence de personnages. Nano Banana 2 reste supérieur sur le photoréalisme des scènes complexes. Un outil pour chaque usage. Plus de modèle unique qui fait tout.

Quant à la recherche d’info pour générer un visuel, là encore méfiance. Test maison cette semaine sur un sujet qui m’est cher (🌸⚡️🌸), ChatGPT est très en retard (visuel de droite, totalement faux).

Conclusion : pour une charte de marque stricte, GPT. Pour une scène vivante, Nano.

Le vrai travail aujourd’hui : choisir le bon modèle selon le besoin. Cohérence texte ou photoréalisme, rarement les deux à la fois.

Le revers de la médaille : les fausses unes

Un point qu’on ne peut pas esquiver. Nico Guyon a alerté cette semaine sur la capacité de GPT Image 2 à générer des unes de journaux crédibles avec ce prompt :

« Réfléchis bien et fais-moi la couverture du journal Le Monde la plus probable selon toi pour le 3 mai 2027 ! ».

Mises en page respectées, typographies copiées, logos intégrés sans faille.

À 18 mois de la présidentielle, les standards C2PA (signatures cryptographiques, watermarking sur les contenus générés) doivent se généraliser. Vite.

La deuxième vague du rapport SIMODS (Science Feedback, mars 2026) vient de chiffrer l’ampleur : 24 % des contenus de désinformation sur TikTok sont générés par IA, 19 % sur YouTube, et 83 % de ces contenus ne portent aucun label.

Sur X, un compte non fiable engrange jusqu’à 10 fois plus d’interactions qu’une source crédible.

Traduction : un écosystème qui paie mieux le faux que le vrai, et qui vient de recevoir une machine à produire du mensonge presque gratuitement.

Tiens, ça me rappelle qu’est sorti en février cet excellent podcast de Radio France : 1984. À ré-écouter d’urgence.

Et donc ?

- Testez GPT Image 2 en mode Thinking sur un cas charte-contraint (infographie, poster, mockup) pour mesurer le gain de temps réel

- Mettez en place un process de fiche personnage pour vos contenus sérialisés (campagnes multi-formats, personas)

- Intégrez C2PA dans vos workflows : tout visuel généré doit être traçable, pour vous comme pour vos audiences

3. Vibe coding, vibe design : la créativité retrouve ses espaces

Sur les 25 dernières années, le web est passé de l’exubérance créative (Flash, sites asymétriques, typographies folles) à une standardisation clinique (frameworks, design systems, conversion-first). Les causes sont connues : performance, maintenabilité, contraintes business, SEO, accessibilité. Autant de bonnes raisons qui, mises bout à bout, ont produit des millions de pages qui se ressemblent.

La courbe de David Serrault relayée par Étienne Mineur met les choses en image. Un pic dans les années 90-2000. Une chute. Et depuis peu, une remontée. Le vibe coding.

Ce que c’est, et ce que ce n’est pas

Le vibe coding (ou dans ce cas précis le vibe design), c’est l’idée qu’un designer ou un créatif décrit une intention (une « vibe », une atmosphère) et que l’IA produit le code. La barrière technique s’efface. Ce qui revient au centre, c’est la direction artistique.

Ce n’est pas du « no-code bricolé ». Ce n’est pas non plus un retour au chaos pré-framework. C’est une redistribution des cartes : la technique devient une commodité, l’originalité fait la différence.

Concrètement, un studio peut aujourd’hui :

- Prototyper une expérience interactive unique en 48 heures

- Tester 10 directions visuelles radicalement différentes en une matinée

- Mesurer l’engagement en conditions réelles avant d’industrialiser

Cette logique s’étend. Anthropic a officialisé Claude Design le 17 avril, propulsé par le nouveau Claude Opus 4.7, pour générer maquettes, prototypes interactifs, decks et supports marketing à partir d’un prompt. L’action Figma a chuté de 9 % dans la foulée, et Mike Krieger (CPO Anthropic) a démissionné du board de Figma trois jours plus tôt : les marchés ont lu le message.

Claude Just Changed Video Editing illustre la même chose pour le montage. Côté vidéo, Artlist Studio réintroduit une timeline éditable, permettant de reprendre la main plan par plan.

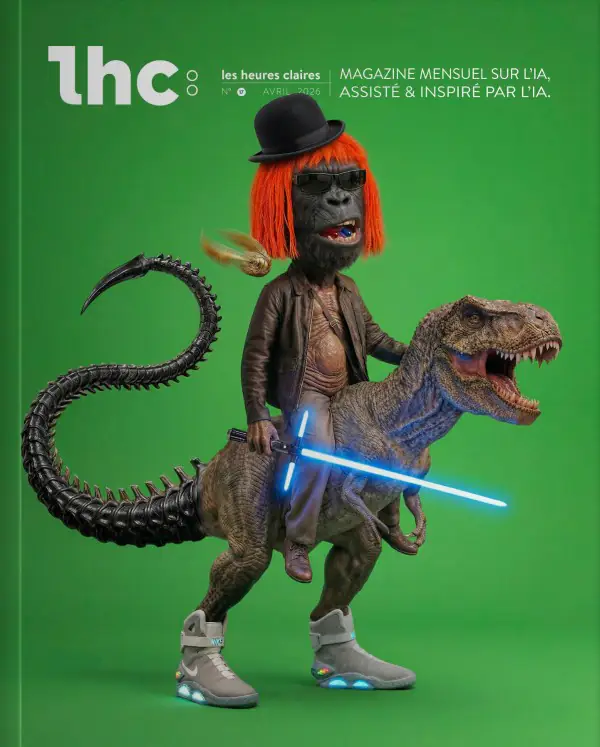

Et si vous voulez vous faire un avis sur créativité et IA, Rémi Rostan vient d’annoncer le dernier numéro de LHC (Les Heures Claires) sur Cafeyn, un magazine mensuel dont 99 % du contenu est assisté par IA, construit avec une vingtaine d’outils génératifs. Ni prototype ni démo : un produit éditorial qui tourne depuis des mois, avec sa communauté de lecteurs, son abonnement, et maintenant une présence sur la plus grande plateforme kiosque numérique française. La preuve par l’exemple : la singularité créative survit à l’automatisation quand la direction artistique est claire en amont.

Ce qui change pour les agences et les marques

Deux choses à mon sens.

D’abord, les délais s’effondrent. Ce qui prenait trois semaines prend trois jours. Les allers-retours clients raccourcissent, la négociation commerciale change autant que la méthode.

Ensuite, le métier se déplace. Moins d’implémentation, plus de conception et de direction. Les studios qui gagneront sont ceux qui gardent la main sur le goût, pas ceux qui automatisent le plus.

Mise en perspective : cette bascule créative n’est pas automatique. Si les équipes refusent de sortir des formats habituels et les clients de prendre un peu de risque visuel, l’IA produira du lisse et du reproductible.

Elle n’inverse rien toute seule.

Et on retrouve mon credo sur la singularité et l’authenticité des marques pour rester visibles à l’heure de l’IA.

On en parle juste en dessous.

Et donc ?

- Ouvrez un bac à sable créatif : un projet pilote où l’équipe design utilise le vibe coding sans passer par la chaîne habituelle d’ingénierie

- Redonnez le brief aux DA : qu’ils formulent des intentions atmosphériques (pas juste des spécifications techniques)

- Mesurez l’engagement différemment : sur ces expérimentations, le KPI n’est pas la conversion mais l’apprentissage

- Documentez vos itérations : ce qui fonctionne, ce qui échoue, comment votre équipe prompte

4. Le contre-mouvement : singularité humaine et mode bourré

Je parle souvent du chemin de crête de l’IA.

Étroit, deux versants.

- D’un côté : biais cognitifs, décrochage, désinformation industrielle, ruptures sociales, facture écologique. La bouillie des derniers mois.

- De l’autre : un outil d’apprentissage, de créativité, d’expansion. Ça existe, mais ça se mérite. Exigence, pratique, temps, formation.

Et justement une voix s’élève beaucoup en ce moment : celle qui s’inquiète de ce que l’automatisation nous fait perdre.

Ce qui devient rare

Alex Imas a publié une réflexion qui mérite qu’on s’y attarde cette semaine sur la rareté future. Son point : quand l’IA produit en masse du texte, de l’image et de l’analyse corrects, ces productions deviennent abondantes donc bon marché. Le rare (et donc la valeur) glisse vers ce que l’IA ne sait pas faire : jugement contextuel, goût, éthique, empathie.

En écho, une tribune signée par plusieurs experts alerte sur l’érosion de notre humanité si l’on délègue sans garde-fous. Et je vous partageais la semaine dernière ce plaidoyer pour la “souveraineté sensorielle” qui théorisait l’ensauvagement de l’esprit face à la saturation algorithmique.

Point commun de ces textes : refuser l’uniformisation sans refuser l’outil.

Le “deuil de l’IA” et le “mode bourré”

Deux concepts pratiques qui circulent beaucoup cette semaine.

ChrysB théorise les 5 étapes du “deuil de l’IA” : déni, colère, marchandage, dépression, acceptation. Le parallèle avec Kübler-Ross est un peu facile, mais il nomme une réalité : les salariés passent par un processus psychologique pour intégrer que leur rôle cognitif de premier niveau est en train de changer.

Plus pragmatique (!), le “mode bourré” relayé par Génération IA : injecter volontairement ses tics de langage, ses fautes, ses métaphores improbables dans le prompt. Pourquoi ? Pour forcer le modèle à sortir de son style aseptisé et retrouver une voix personnelle. C’est technique et aussi philosophique : on prompte avec ses aspérités humaines, pas malgré elles.

À l’opposé, Tokenmaxxing décrit la gamification de la productivité dans la Silicon Valley : optimiser à outrance l’utilisation de tokens, en faire un indicateur de statut. La productivité comme trophée. L’anti-mode-bourré.

La méthode Karpathy : le “second cerveau”

Au milieu, Andrej Karpathy propose une méthode pour bâtir le “second cerveau” alimenté par l’IA dont je vous parlais la semaine dernière.

L’idée est simple : utiliser la machine pour stocker, indexer, structurer vos connaissances, mais garder l’apanage humain sur la synthèse et les connexions inattendues.

C’est peut-être la voie la plus mûre. Pas un refus frontal de l’IA. Pas non plus une soumission. Une division du travail : la machine pour la mémoire et l’exhaustivité, l’humain pour l’intuition et les connexions.

Et donc ?

- Expérimentez le “mode bourré” * sur un prompt stratégique (pitch, édito, manifeste) et comparez le résultat au prompt “clean”

- Identifiez les compétences rares de votre équipe : ce qui ne se prompte pas, ce qui ne se synthétise pas, ce qui fait votre signature

- Instaurez des rituels déconnectés : une réunion par semaine sans IA, pour entretenir le muscle de la friction créative directe

- Cartographiez vos processus : lesquels doivent rester artisanaux pour préserver la voix de l’entreprise ?L’abus d’alcool est dangereux pour la santé, à consommer avec modération

*L’abus d’alcool est dangereux pour la santé, à consommer avec modération

BRÈVES & SIGNAUX FAIBLES

Business & Stratégie LLM

Anthropic devant OpenAI sur les revenus annualisés. Les données relayées par Lenny Rachitsky montrent qu’Anthropic dépasse désormais OpenAI sur la courbe des revenus annualisés, avec une clientèle entreprise qui double sur quelques mois. Et donc ? La course n’est plus jouée. Le pari stratégique de Claude sur la fiabilité et les usages pro paie.

Outils IA

HeyGen Instant Highlights V2 et HyperFrames. HeyGen a sorti son outil de découpage automatique de clips, et HyperFrames convertit du HTML en MP4. Et donc ? La chaîne vidéo complète (génération, montage, format) s’automatise. Les studios qui n’ont pas testé ces outils dans un workflow prototype sont en retard.

Higgsfield Marketing Studio. Le pipeline publicitaire end-to-end : du produit à la pub finalisée en un seul flux. À tester sur un produit simple pour mesurer le gap avec un process actuel.

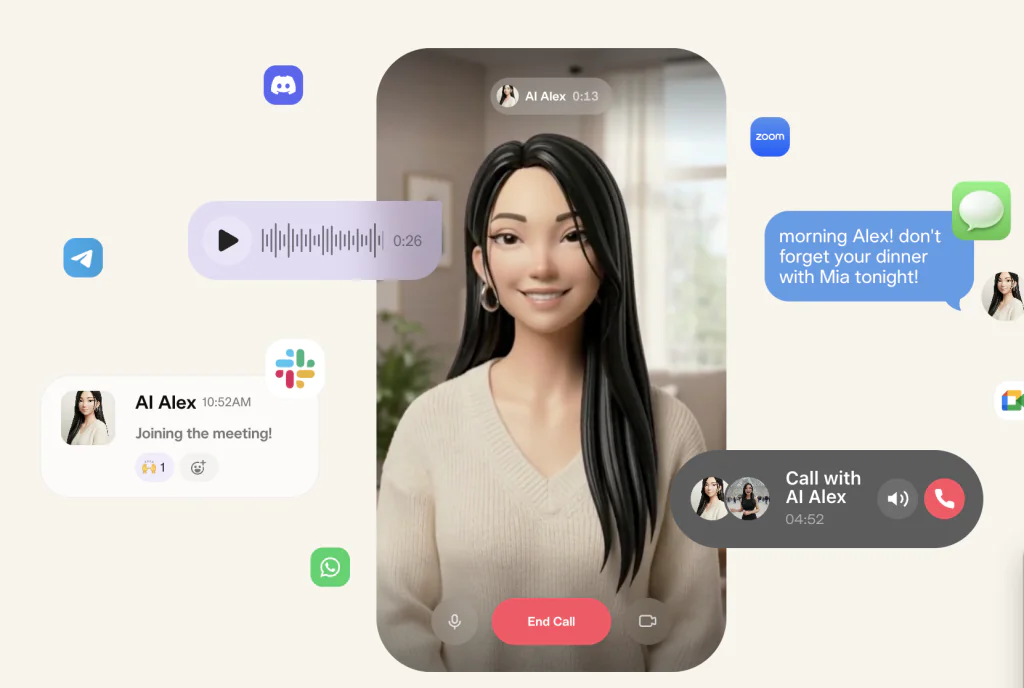

Pika : clones digitaux pour Google Meet. Pika propose désormais la création d’avatars interactifs pour les réunions Google Meet. Et donc ? La présence en visio devient scriptable. Questions à se poser : éthique, consentement, signalement.

Créez les vidéos time-freeze avec Higgsfield dont on parlait la semaine dernière. Un tutoriel rapide pour produire des plans “freeze” cinématiques en deux étapes. Le genre d’effet qui demandait un shoot spécialisé se fait en 10 minutes. Le risque : ne voir plus que ça… Bye bye singularité.

Productivité & Tips

Claude Design en pratique : la méthode Hassid. Ruben Hassid partage ses prompts et astuces pour Claude Design : workflow vidéo animée puis conversion en deck pour la meilleure qualité, import d’un DESIGN.md de marque pour reproduire exactement votre style. Et donc ? Si vous avez testé Claude Design cette semaine et que le résultat était générique, c’est la ressource à lire avant de relancer.

BIGRecap #89 : 230 news IA en une seule synthèse. La synthèse du 7 au 20 avril par Emmanuel Vivier : Claude Design, Projet Glasswing, Mythos, Managed Agents, Seedance 2.0. Pour compléter ce qu’on ne peut pas traiter ici, la ressource de référence.

Société & Signaux faibles

Le Health Data Hub bascule sur Scaleway. Alain Garnier décrypte l’annonce : la plateforme française de données de santé quitte Microsoft Azure pour un hébergement souverain chez Scaleway. Six ans après le choix d’un hyperscaler américain largement contesté pour des données sensibles, le HDH change de camp. Et donc ? Un signal politique et industriel fort. La souveraineté numérique cesse d’être un discours pour devenir une décision opérationnelle sur un dossier à forte valeur symbolique.

17 ans de vie devant l’écran. Marcus Byrne rappelle qu’en moyenne, un humain passera 17 ans de sa vie devant l’écran de son téléphone. Et donc ? Derrière la stat choc, une vraie question hygiénique.

Le “numérique sensible” devient un sujet de santé publique. En termes de créativité, l’IA semble un bon outil pour symboliser le temps qui passe, y compris avec de belles idées créatives.

Flipbook : chaque pixel streamé en direct. Un prototype où l’interface utilisateur devient un flux vidéo 1080p/24fps généré en live (mais beaucoup plus lentement que la démo). Et donc ? Signal faible fascinant sur la future architecture des OS et applications.

☕ Un café en vrai ?

Trois questions pour prolonger la réflexion cette semaine :

- Votre entreprise a-t-elle un registre des agents IA déployés, avec propriétaires et protocoles d’audit ?

- Comment vos équipes créatives s’emparent-elles du vibe design pour sortir des patterns standardisés ?

- Quelles compétences humaines rares (jugement, goût, éthique) allez-vous prioriser en 2026 face à la commoditisation cognitive ?

Autant de sujets que nous aimons explorer chez RnD.

Pourquoi ne pas en parler autour d’un café (virtuel ou réel) ?

Newsletter

Chaque samedi matin retrouvez une synthèse des informations du marketing digital à replacer lors de votre prochaine réunion.