RnD Café ☕️ – #423

21 février 2026

Au sommaire cette semaine

- OpenClaw : l’agent autonome qui rapporte un job en millions à son créateur

- Gouvernance agentique : de l’accès aux actions autorisées (capabilities)

- Employee influencers : 8x plus d’engagement que le corporate

- Shadow Listening : enregistrer sans bot (+ enjeux RGPD)

- Seedance recule : ByteDance ajourne son API deepfake

- Pub dans ChatGPT : OpenAI lance les tests

- Talk to Data : l’analyse conversationnelle arrive

Vous n’avez que 5 minutes ?

👉 Voir le résumé Slides/Vidéo (5′)

👉 Voir l’infographie

👉 Parcourir les 15 slides

👉 Version podcast RnD Expresso (5′)

Vous avez 10-15 minutes devant vous ?

👇 Bonne lecture !

Toutes les synthèses ci-dessus sont produites à partir des 84 sources de la semaine, in extenso via NotebookLM.

Agents partout, Humains devant.

La semaine dernière, je vous expliquais que nous devons devenir des « architectes d’intention » : définir ce qu’on veut, puis laisser l’IA exécuter seule.

Février 2026 le confirme clairement : nous sommes sortis de l’ère du chatbot docile.

Les agents proactifs débarquent. Le cas d’OpenClaw dont nous vous parlons depuis quinze jours est emblématique : un framework (c »est-à-dire une architecture logicielle complète) qui transforme le chatbot Claude en un assistant capable de vérifier vos emails, passer des appels, agir pour vous. Son créateur ? Recruté par OpenAI lundi pour piloter leurs agents personnels. Message reçu : l’autonomie agentique est l’enjeu central de 2026.

Mais cette évolution crée un sacré paradoxe.

D’un côté, la technique s’envole. Les agents gagnent en autonomie, deviennent invisibles, proactifs. On passe du « Dis-moi » au « Fais-le ». Vraiment. Je vous raconterai bientôt nos expérimentations quotidiennes…

De l’autre, les signaux d’alerte se multiplient.

Deepfakes à échelle industrielle, le shadow listening qui se développe au mépris de la loi, 73% des usagers craignent que leurs prompts soient rendus publics.

Et Ethan Mollick qui alerte sur le risque de « somnolence intellectuelle », à savoir laisser l’IA penser à notre place.

Et le paradoxe ?

Cette automatisation censée nous libérer intensifie notre charge au lieu de l’alléger. L’étude de la Harvard Business Review que je vous partageais la semaine dernière continue à faire du bruit.

En résumé : l’IA générative ne réduit pas la charge de travail : elle l’intensifie. Les pauses disparaissent, le travail devient « ambiant » (toujours possible, toujours tentant), et les collaborateurs font des tâches hors de leur périmètre (les marketeurs codent, les chercheurs font de l’ingénierie)…

Face à cette marée de contenu synthétique, les entreprises redécouvrent l’évidence : la valeur refuge, c’est l’humain identifiable.

Pas le compte corporate lissé, mais vos employés avec leur authenticité.

L’employee-generated content devient une arme commerciale redoutable précisément parce qu’elle est difficilement simulable.

Cette édition explore donc cette confrontation entre autonomie technique et besoin d’authenticité. Les agents peuvent coder, négocier, réserver à votre place. Mais ils ne remplaceront jamais la confiance qu’inspire une personne qui s’engage.

Nous entrons dans une phase où l’adoption de l’IA exige une gouvernance rigoureuse. Les entreprises qui réussiront exploiteront l’autonomie en gardant la main sur trois piliers :

- la culture humaine

- la technologie

- les contrôles.

Au risque assumé d’être un poil lapidaire : celles qui échoueront auront confondu automatisation et abdication.

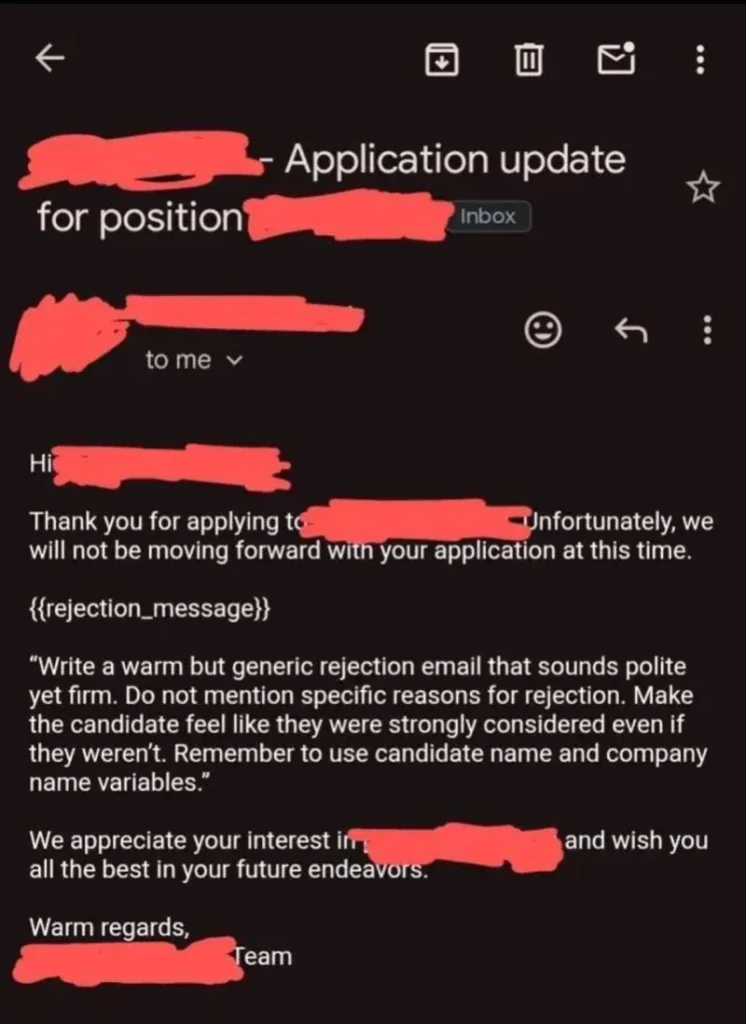

Comme par exemple cette « sublime » lettre de refus reçue in extenso par un candidat… Lire une réponse possible pleine de finesse en premier commentaire de ce post 👆

Bonne lecture quand même.

IA/USAGES : Agents IA et automatisation, quand l’IA prend les commandes

Commençons par les agents.

Donc… le chatbot qui attend votre question, c’est fini. Nous entrons bien dans l’ère des agents autonomes qui vérifient vos emails, passent des appels sans attendre d’instruction.

OpenClaw : le signal qui ne trompe pas.

Ce framework marque le passage d’une IA réactive à un assistant autonome. Comme l’explique Nicolas Guyon, OpenClaw transforme les modèles en agents capables de gérer emails, briefings personnalisés, appels téléphoniques.

Le cas Nat Eliason & son agent Felix expose une stack (une architecture technique) réelle avec 28 outils différents. Démonstration qu’un entrepreneur solo peut créer un agent personnel utile et rémunérateur.

Qui a crée Open Claw ? Un développeur autrichien, Peter Steinberger, recruté donc lundi par OpenAI pour piloter leurs agents personnels (Open Claw devient une fondation indépendante, open source, soutenue par une communauté énergique… et par OpenAI). Des rumeurs circulent : le premier « solo-founder » milliardaire pourrait naître de cet écosystème. Le projet a suscité des tensions, Anthropic ayant menacé le développeur avant qu’OpenAI contre-attaque.

Le vrai défi : industriel, pas technique

OpenClaw montre que l’agentification est une réorganisation des responsabilités techniques. Le défi est industriel (sécurité, tests, intégrations) plus que technique. Les équipes produit doivent se réinventer : architectes d’API, tests JiT (Just in Time -> au lieu d’écrire les tests manuellement AVANT de coder, le LLM génère les tests à la volée pendant que l’agent développe), responsables de gouvernance.

Les référentiels traditionnels ne suffisent plus. Il faut passer d’une gouvernance « par accès » à une gouvernance « par capabilité » : qui peut faire quoi, comment, avec quelle traçabilité ?

Bret Taylor, ancien co-CEO de Salesforce, va plus loin : les compétences valorisées évoluent vers la conception d’architectures d’agents, la sécurisation des accès, la validation métier. Le métier de demain ? « Manager d’agents« .

La question qui vous sera posée demain en entretien d’embauche par vos candidats :

« Voici mon expérience. Je viens avec mes X agents. Quel sera mon budget tokens mensuel ? »

Traduction : au-delà de mes compétences, j’ai développé des outils (des agents) qui me rendent plus performant. Mais avez-vous de quoi les nourrir ? (Les tokens, c’est le carburant des IA : chaque requête en consomme, chaque requête se paie.)

Une science de la mise à l’échelle

Google Research publie une étude identifiant les conditions où les agents fonctionnent : modularité des rôles, rétroaction continue, supervision humaine ciblée.

A retenir : les agents réussissent quand ils complètent une chaîne décisionnelle, pas quand ils la remplacent.

L’émergence d’un écosystème structuré

Cette convergence attire d’autres acteurs :

- Manus AI développe des agents « toujours actifs » compatibles OpenClaw, tournant 24/7

- Kimi K2.5 génère des rapports d’industrie niveau McKinsey, démocratisant l’accès aux analyses sophistiquées

- Listen Labs introduit un Research Agent menant des entretiens utilisateurs de façon autonome

- CoworkPowers propose des patterns de productivité qui se démultiplient avec le temps

Les angles morts

Et il y en a. Evidemment.

- Ethan Mollick alerte sur la « somnolence intellectuelle » : laisser l’IA penser à notre place atrophie notre analyse critique.

- Côté sécurité, 73% des utilisateurs craignent que leurs prompts soient rendus publics.

- The Guardian rapporte que les deepfakes sont utilisés à échelle industrielle. Seedance 2.0 en est l’illustration parfaite. L’éditeur de cette nouvelle avancée dans la génération vidéo (ByteDance) devait ouvrir son API le 24 février. Report sec, sans nouvelle date. Cause probable : renforcement anti-deepfake et anti-copyright suite à la pression de SAG-AFTRA, Disney et la MPA. La démo virale Tom Cruise vs Brad Pitt que je vous ai partagée, a eu l’effet inverse d’une publicité. Pour une fois, un acteur tech ajuste son produit avant l’explosion publique plutôt qu’après. Le « move fast and break things » rencontre ses limites quand ce qui casse, ce sont des droits à l’image. L’inconnue : les garde-fous produiront-ils un outil bridé inutile ou un équilibre viable entre puissance et conformité ? (vu chez Gilles Guerraz)

- Shadow listening ou quand l’IA écoute vos réunions en silenceFini les bots intrusifs qui rejoignent vos visios avec un message gênant « Recording has started ». Une nouvelle génération d’outils transcrit vos réunions en arrière-plan, directement depuis votre micro.

- Granola (🇺🇸) fonctionne comme Apple Notes dopé à l’IA : pas de bot, transcription locale, résumés automatiques, todo list automatiques.

- Plaud (🇺🇸) va plus loin avec un boîtier physique ultra-fin qui enregistre tout, même vos appels téléphoniques et réunions en présentiel.

- Dicte.ai (🇫🇷) joue la carte de la souveraineté : serveurs à Paris, chiffrement post-quantique, audio supprimé après traitement. C’est mon chouchou !

- Granola (🇺🇸) fonctionne comme Apple Notes dopé à l’IA : pas de bot, transcription locale, résumés automatiques, todo list automatiques.

- Cela dit, ces outils normalisent une écoute passive qui pose de vraies questions RGPD : où vont les transcriptions ? Servent-elles à entraîner des modèles ? Et surtout : vos interlocuteurs savent-ils qu’une IA les écoute ?

Rappelons qu’en France, enregistrer une conversation sans le consentement des participants et/ou des salariés reste illégal (Art 226-1 du code pénal : atteinte à la vie privée / Art. L1222-4 du code du travail : information préalable du salarié).

Donc oui ce sont des outils très puissants et dont il serait idiot de se passer (« Rappelle moi toutes les tâches que j’ai à gérer issues des réunions de la semaine« ), mais faites le de manière responsable (« Tout le monde est ok pour que j’enregistre ce meeting ?« ) et… partez du principe que vous serez enregistré dans 100% des cas (en visio, en réunion, au tél.).

Les outils établis s’adaptent aussi !

NotebookLM (mon premier outil 2025) ajoute enfin l’édition fine avec son outil « Crayon » et l’export PPTX natif. Les présentations générées par IA deviennent directement modifiables dans PowerPoint. On attendait cela avec impatience.

En résumé.

Les entreprises doivent :

- Définir des rôles : qui autorise quelles actions pour quel agent ?

- Centraliser la journalisation avec logs structurés (pouvoir expliquer qel agent a fait quoi)

- Former des contrôleurs d’agents pour valider les décisions complexes

- Créer un catalogue des actions autoriséespar agent

MARKETING : L’humain comme signal de confiance

Face au déluge de contenus synthétiques et de slop (« bouillie »), l’authenticité devient rare. Les marques redécouvrent l’évidence : un post d’employé génère plus d’engagement et de portée qu’un post corporate. Les algorithmes le savent depuis longtemps.

Le contenu généré par les employés prend le pouvoir

Les consommateurs se détournent des logos pour écouter les visages. Sprout Social révèle que le contenu employé génère 8 fois plus d’engagement que les posts officiels. 90% des consommateurs considèrent l’authenticité comme facteur clé d’achat.

Mais activer ses employés nécessite un cadre, une formation, des incitations. Sans règles, vous risquez des messages contradictoires ou compromettants.

Suivez le blog de Sociabble pour analyser ces tendances.

Les employés influenceurs peuvent produire du contenu frais, géolocalisé et authentique. Un employé local publiant sur un sujet récent a plus de chances d’être source pertinente pour les moteurs IA.

Ecommerce : Google AI Mode passe à la caisse

Google AI Mode déploie le paiement UCP, permettant des achats via requêtes conversationnelles. L’assistant ne recommande plus, il concrétise la transaction.

C’est la suite logique de l’agentic commerce : demain, c’est l’IA qui achète. Si votre boutique n’est pas lisible par la machine, elle n’existe pas.

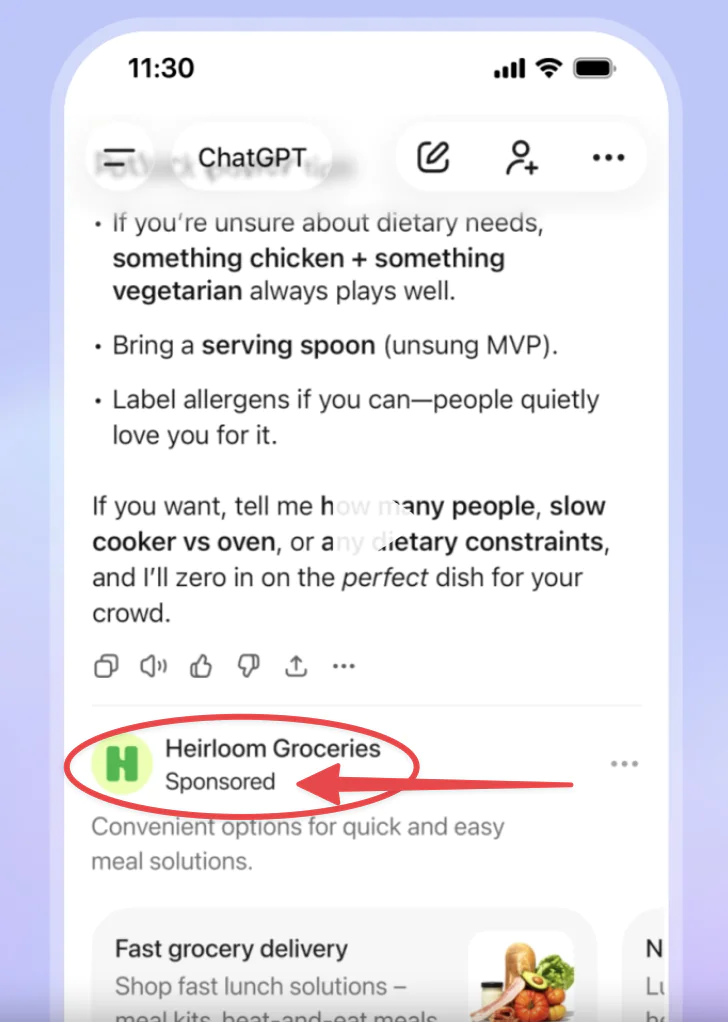

OpenAI teste la publicité dans ChatGPT

OpenAI annonce tester des publicités dans ChatGPT, avec un ticket d’entrée qui ne laisse aucun doute sur le positionnement : minimum 200 000$ d’engagement.

Source : Adweek

Un tournant majeur dans la monétisation des assistants IA.

Le modèle économique se précise : CPM à 60$ vendu sur impressions plutôt que sur clics (eMarketer), divergeant des modèles performance de Google Search ou Amazon Ads. Les premières catégories testées (retail, streaming, services internet) visent à démontrer la pertinence contextuelle dans les prompts conversationnels.

L’ironie du timing : Sam Altman déclarait encore en octobre 2024 qu’il « détestait » les publicités et trouvait l’idée de mélanger pubs et IA « particulièrement perturbante » (Search Engine Journal). Quelques mois plus tard, la réalité financière l’emporte. Avec environ 900 millions d’utilisateurs hebdomadaires estimés, la pression pour diversifier les revenus au-delà des abonnements devient intenable.

En clair : Les marques doivent anticiper comment se positionner dans ces nouvelles surfaces conversationnelles. Pour les 99% qui n’ont pas 200 000$, la priorité reste l’optimisation organique pour les citations ChatGPT. Pour le 1% qui peut investir, la question devient : la valeur d’apprentissage justifie-t-elle l’investissement même sans ROI garanti ?

Talk to Data : l’analyse conversationnelle arrive à maturité

Très bonne question posée par un apprenant cette semaine dans une formation où j’intervenais cette semaine.

« Quand est-ce que je pourrai juste demander à l’IA : montre-moi les ventes Q4 par région, et avoir la réponse ? »

On parle ici de NQL : Natural Language Query.

Ce rêve devient réalité avec le Conversational Analytics, aussi appelé Text-to-SQL ou Agentic RAG.

Tableau AI, Power BI Copilot et startups spécialisées proposent désormais des pipelines intelligents : Intention → Reformulation → Query → Factcheck.

Ne sous-estimez pas le dernier point. Gare aux hallucinations quand vous demandez un chiffre pour votre conseil d’administration.

La parade existe : décomposer en agents spécialisés qui jouent les contrôleurs les uns des autres. Un agent interprète, un autre requête, un troisième vérifie la cohérence.

11 usages IA pour le social media

Hootsuite détaille 11 applications concrètes au-delà du contenu : écoute sociale augmentée, analyse de sentiment, modération assistée, optimisation des horaires, personnalisation dynamique. En clair : Commencez par automatiser curation et modération avant de confier la prise de parole publique à un agent !

Et pour finir, les deux vidéos de la semaine.

Ce qui impressionne n’est pas tant le résultat que la concision du prompt pour arriver à cette vidéo de 15s :

Speeder chase across a cliff city (single continuous shot) From a monumental cliffside city carved into stone, the camera dives toward a tiny streak of light ripping along a narrow ledge-road. Lock-on: a speeder hugging the wall at insane speed. The camera slingshots ahead, whips back, then drops tight to the rear thrusters: heat haze, grit snapping off the ledge, warning lights flashing. A collapsing balcony rains debris; the rider snaps a last-inch swerve under a falling arch, then threads through hanging laundry lines and open windows in one fluid line. The camera darts through the same openings, staying glued to the motion. One final bend and sudden calm: the camera blasts outward into a reveal of the city opening onto a boundless waterfall-fed valley, mist turning into rainbow.

Les Dor Brothers provoquent Hollywood

Le collectif berlinois a publié un court-métrage de 3 minutes 15 entièrement généré par IA en 24 heures, revendiquant « une valeur de production équivalente à un film à 200 millions de dollars » (Putsch). Créé avec Seedance 2.0 et Runway, « Apex » met en scène destruction massive, effets spectaculaires et même un caméo de Trump. Le scénariste Rhett Reese (Deadpool) a réagi : « C’est probablement terminé pour nous. » Geo.tv . Le signal est clair : la barrière à l’entrée s’effondre, le centre de gravité du pouvoir créatif se déplace Putsch.

☕ Un café en vrai ?

Trois questions pour prolonger la réflexion cette semaine :

- Quels accès êtes‑vous prêts à donner à un agent demain ? (email, finance, agenda)

- Vos équipes sont-elles prêtes à devenir des visages publics de la marque ?

- Qui valide les décisions prises par vos agents IA ?

Nous sommes à l’intersection entre une opportunité d’efficacité réelle et une responsabilité accrue. En résumé : le progrès technique n’est utile que si vous définissez les règles du jeu. Et donc ? Commencez par petites étapes, mais commencez aujourd’hui.

Alors, pourquoi ne pas en parler autour d’un café (virtuel ou réel) ?

Newsletter

Chaque samedi matin retrouvez une synthèse des informations du marketing digital à replacer lors de votre prochaine réunion.