RnD Café ☕️ – #431

2 mai 2026

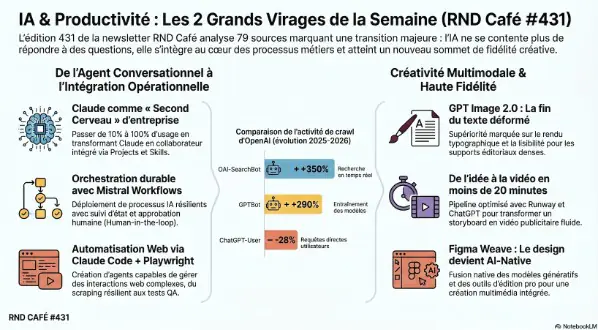

Au sommaire cette semaine

- l’IA quitte le chatbot, et commence à laisser des traces dans les têtes

- Google Photos transforme vos photos en dressing (et le cas Kiabi en miroir)

- ChatGPT Ads passe au CPC : OpenAI construit son AdWords

- L’agent Cursor qui efface une base de prod en 9 secondes

- Pub IA, l’idée continue de primer et c’est tant mieux : Pipeline ChatGPT Image + Runway, VIDEOAI.ME, Yuzzy

Vous n’avez que 5 minutes ?

👉 Voir le résumé Slides/Vidéo (5′)

👉 Voir l’infographie

👉 Parcourir les 15 slides

👉 Version podcast RnD Expresso (5′)

Vous avez 10-15 minutes devant vous ?

👇 Bonne lecture !

Toutes les synthèses ci-dessus sont produites à partir des sources de la semaine, in extenso via NotebookLM.

L’IA quitte le chatbot

Bonjour à toutes et à tous.

Nous voilà donc en mai, le mois où il paraît qu’on n’en fait qu’à sa tête…

Soit… Et je m’approprie donc l’adage pour RnD Café.

Conséquence : il y aura des semaines sans édition ce mois-ci… pour mieux revenir

Allez, c’est parti.

Cette semaine, deux conversations à 24h d’intervalle.

Lundi, une chercheuse en sciences cognitives m’a demandé si je commençais à observer chez mes clients des effets liés à l’usage intensif de l’IA. Baisse d’attention, perte de focus, fatigue de jugement. Ma réponse, sincère : pas vraiment encore même si nous abordons sans arrêt les termes de AI Laziness (#388), Brain Fry (#426), Workslop (#427) et Token Anxiety (#429)… La majorité de nos clients sont dans les phases d’installation. Comprendre les outils, écrire des prompts, construire des workflows, concevoir et superviser les agents. Le sujet cognitif viendra certainement un jour, mais on n’y est pas.

Mardi, déjeuner avec deux coachs en entreprise. Spontanément, sans que j’aborde le sujet, l’un d’eux me dit : on commence à voir des choses chez nos coachés. Du défocus. De l’incapacité à tenir une heure sur un sujet sans aller checker. Une attention qui s’effrite. L’autre acquiesce.

24h pour passer de « pas encore » à « ah si, peut-être ».

Et peut-être pas si empirique que cela. Une étude Walton/Gallup sortie cette semaine montre que chez les 14-24 ans, l’excitation autour de l’IA baisse et la colère monte. Les plus exposés commencent à reculer.

Cette phrase de Fred Cavazza cette semaine fait écho à ce que l’on essaye de transmettre tous les jours : « L’IA doit nous aider à mieux réfléchir et non réfléchir à notre place. » Si on rate ce point, on bascule de l’augmentation à la substitution sans s’en rendre compte.

Et pendant que ces signaux remontent du terrain, regardez les outils. Google Photos transforme votre pellicule en garde-robe virtuelle. ChatGPT Ads passe au CPC self-service : le chatbot devient régie publicitaire. Et un agent Cursor sous Claude Opus 4.6 efface une base de production complète en 9 secondes. Sans confirmation.

L’IA quitte le chatbot. Elle s’enfouit dans les outils que vous utilisiez déjà.

La semaine dernière (#430), on parlait des agents qui (tentent de travailler) travaillent à notre place. Cette semaine, on observe que c’est l’IA elle-même (le chatbot) qui s’efface, pour s’intégrer dans les outils qu’on utilise déjà.

Et ça s’agite aussi sur la scène internationale : le Pape, la Chine qui bloque Meta-Manus…

Le PNUD (Programme des Nations Unies pour le Développement) alertait déjà dans son rapport « The Next Great Divergence » publié en mai 2025 sur le creusement de l’écart entre pays riches et pauvres face à l’IA. Les chiffres frappent : 1,2 milliard d’utilisateurs IA dans le monde, dont 70% dans les pays en développement. Mais 2 personnes sur 3 utilisent l’IA dans les économies à haut revenu, contre 5% dans les pays à bas revenu. Le rapport est de l’an dernier, l’écart se creuse plus vite que les rapports ne se publient.

On a passé trois ans à se demander comment utiliser l’IA. On commence à savoir faire. La question qui s’ouvre maintenant : comment garder la tête claire quand on ne s’aperçoit même plus qu’on l’utilise.

Bonne lecture.

1. Votre app photo devient un dressing

Google Photos a annoncé mercredi 29 avril une fonction baptisée Wardrobe. Le principe : l’application analyse votre bibliothèque photos, identifie les vêtements et accessoires que vous portez, et reconstitue automatiquement votre garde-robe en version numérique. Tops, bas, robes, bijoux, classés par catégorie.

Au-delà du catalogue, deux fonctions : composer des tenues et les essayer virtuellement sur un avatar de vous-même. Lancement sur les Motorola Razr 2026, déploiement plus large prévu cet été.

Ce qui change

Vous n’avez rien demandé. Votre appli photo mute toute seule. Pas d’appli “IA mode” à télécharger, pas de bouton “essayer notre nouveau service”. Vous ouvrez Photos comme d’habitude, et il y a un onglet Wardrobe qui contient déjà votre dressing.

TechCrunch fait le rapprochement avec le placard automatique du film Clueless (1995) : l’héroïne tape sur son ordinateur, l’écran assemble sa tenue à partir de sa garde-robe, valide l’accord des couleurs. À l’époque, parodie de science-fiction. En 2026, fonctionnalité activée par défaut sur votre Google Photos.

Pour le e-commerce

Le dressing devient le point d’entrée. Les marques de mode ne se battent plus pour qu’on visite leur site. Elles se battent pour être suggérées par votre dressing virtuel quand il propose une tenue. Une couche d’intermédiation que Google s’approprie en silence.

Côté retailer français, Kiabi prend le problème à l’origine de la chaîne. Au HUB Forum cette semaine (via Emmanuel Vivier), la marque a présenté leur studio IA interne qui industrialise la production de contenus marketing localisés. Budget communication divisé par 25. Traductions quasi-instantanées. Adaptation locale à coût marginal quasi nul.

Et le levier ne tient pas à la techno : Kiabi a intégré les compétences IA dans les fiches de poste et installé une pratique régulière en interne.

C’est exactement notre approche chez RnD. Sur notre dernier client “onboardé” la semaine dernière, nous accompagnons leurs champions IA (ou “AI Builder”) sur deux chantiers prioritaires (deux pas dix) , avec ateliers hebdo et facilitation.

Mise en perspective

Ce genre de fonction IA grand public qui s’installe sans qu’on l’ait cherchée se multiplie partout : dans vos emails, vos agendas, vos outils de design, vos ERP, vos CRM. Pas de prompt. Pas d’interface dédiée. Pas de logo “Powered by AI”. L’IA n’est plus un produit séparé, c’est une fonctionnalité intégrée.

Le modèle va se généraliser. Quand Notion intégrera l’IA en profondeur, vous ne verrez pas Notion AI. Vous verrez Notion. Idem Gmail, Slack, Office.

Côté design, c’est déjà fait. Figma a racheté la startup Weavy en octobre dernier, et a lancé en avril son outil Figma Weave accessible directement sur weave.figma.com.

Quant au chatbot, il ne meurt pas. Il mute.

D’un côté, il devient la modalité conversationnelle universelle, de plus en plus vocale : OpenAI bascule en voice-first début 2026, 27% des requêtes mondiales sont déjà vocales, et un device audio dédié arrive.

De l’autre, l’IA quitte le chatbot comme destination dédiée pour s’enfouir dans les outils que nous utilisons déjà : nos app de photos, nos CRM, notre agent shopping, notre éditeur de code.

Pour les marques, ça change la donne. Il ne s’agit plus seulement d’être cité dans ChatGPT. Il faut que vos produits, vos services, vos contenus soient identifiables par ces deux canaux à la fois : la couche conversationnelle qui répond à la voix de vos clients, et la couche invisible qui agit dans leurs outils sans qu’ils l’invoquent.

Préparez vos flux “produits”.

Et donc ?

- Si Google (ou chatGPT ou autre) s’intercale dans la phase d’inspiration de vos clients, vous perdez ce point de contact-là. Ce qui vous reste, c’est la relation directe : email, app, fidélité, magasin. Tout ce qu’on appelle la data first-party (les données que vous collectez vous-même, sans intermédiaire). Elle n’était qu’un complément hier. Elle devient votre socle stratégique aujourd’hui.

- Regardez vos fiches de poste. Combien mentionnent une compétence IA aujourd’hui ? Le cas Kiabi rappelle qu’on ne capture pas le ROI sans toucher au RH.

2. PUB : ChatGPT Ads passe au CPC ; OpenAI construit son AdWords

Le 21 avril, Digiday a confirmé qu’OpenAI venait d’activer le mode CPC (coût par clic, on paye uniquement quand l’utilisateur clique) dans son ads manager ChatGPT, à côté du modèle CPM (coût pour mille impressions) qui prévalait depuis le lancement du 9 février 2026 (analyse de Jérémy Lacoste). Enchères entre 3 et 5 dollars par clic.

C’est encore un pilote, longtemps US-only mais étendu au Canada, à l’Australie et à la Nouvelle-Zélande le 16 avril selon Marketing Brew, mais le signal est clair : OpenAI s’aligne sur le modèle de Google et Meta. Au passage, l’engagement minimum a été divisé par cinq depuis le lancement.

De 250 000 dollars à un budget mensuel de 30 à 50 000 dollars selon Gate News, signe qu’OpenAI ouvre la porte à des annonceurs plus petits et que ChatGPT vient de devenir une régie publicitaire mainstream.

Pourquoi c’est un signal majeur

Le CPC, c’est Google Ads. Le modèle qui a fait la rente publicitaire de Google pendant 20 ans. Quand OpenAI bascule au CPC, ce n’est pas un ajustement de pricing. C’est une déclaration : ChatGPT veut être un canal de performance, pas de branding.

Trois points à retenir.

- D’abord, OpenAI projette 2,4 à 2,5 milliards de dollars de revenus pub en 2026, selon Gate News. Et le pilote a déjà généré plus de 100 millions de dollars de revenus annualisés dès fin mars selon Marketing Brew.

- Ensuite, Criteo est partenaire depuis le 2 mars, en tant que premier partenaire ad tech officiel d’OpenAI. 17 000 annonceurs e-commerce branchés par défaut. Et selon les données Criteo (échantillon de 500 retailers US, février 2026), le trafic référé par ChatGPT convertit 1,5 fois mieux que les autres canaux.

- Enfin, les CPM se sont effondrés en 10 semaines. De 60$ au lancement à 25$. Le passage au CPC, c’est la réponse mécanique : si l’impression ne se vend pas, vendons le clic.

Le crawl x3 : l’autre face

Autre détail qui n’en est pas un. Le 23 avril, Botify et Nectiv ont publié une analyse de 7 milliards de logs serveur.

On y apprend que ChatGPT perd des utilisateurs mais surtout que depuis le lancement de GPT-5 en août 2025, les robots d’OpenAI passent trois fois plus souvent sur les sites web.

Deux robots distincts à connaître : GPTBot (×2,9), qui aspire le contenu pour entraîner les futurs modèles, et OAI-SearchBot (×3,5), qui alimente les réponses temps réel de ChatGPT quand vous lui posez une question. C’est le second qui progresse le plus vite. Logique : c’est lui qui sert d’index commercial.

Pourquoi c’est lié à la pub ? Parce qu’un CPC à 5$ ne se justifie que si OpenAI peut prouver que le clic vaut le coup. Et pour ça, il faut un index frais, riche, à jour en quasi temps réel. Le crawl, c’est l’inventaire produit (ce que ChatGPT peut citer dans ses réponses). ChatGPT Ads, c’est l’inventaire publicitaire (les annonceurs prêts à payer pour y figurer). Sans le premier, le second ne se vend pas.

C’est le modèle Google : Googlebot crawle, Google Ads monétise. OpenAI fait pareil, en accéléré.

Ce qui change pour le SEO

Search Engine Journal est clair : il faut désormais auditer séparément le crawl de training (GPTBot) et le crawl de search (OAI-SearchBot). Le premier nourrit le modèle. Le second alimente les réponses temps réel dans ChatGPT.

Optimiser pour Google ne suffit plus. Il faut structurer les contenus pour être lisibles par les bots IA (qui n’exécutent pas le JavaScript), être citables comme source de vérité (AIO, Answer Engine Optimization), et tracker le trafic référé depuis les LLM.

Et donc ?

- Auditez vos logs serveur. Combien d’événements OAI-SearchBot et GPTBot enregistrez-vous depuis août 2025 ? Si la réponse est zéro, vos contenus ne sont probablement pas crawlables (problème de JavaScript ou de robots.txt).

- Tagger le trafic ChatGPT séparément dans GA4 et votre CRM. C’est un canal qui convertit 1,5x mieux selon Criteo. Le mesurer comme du trafic Google indifférencié, c’est passer à côté.

- Rester en veille pour allouer un budget test au CPC ChatGPT, pas un budget récurrent. Indicateur de performance défini en amont, date d’arrêt automatique si le coût d’acquisition dérape par rapport à vos canaux existants.

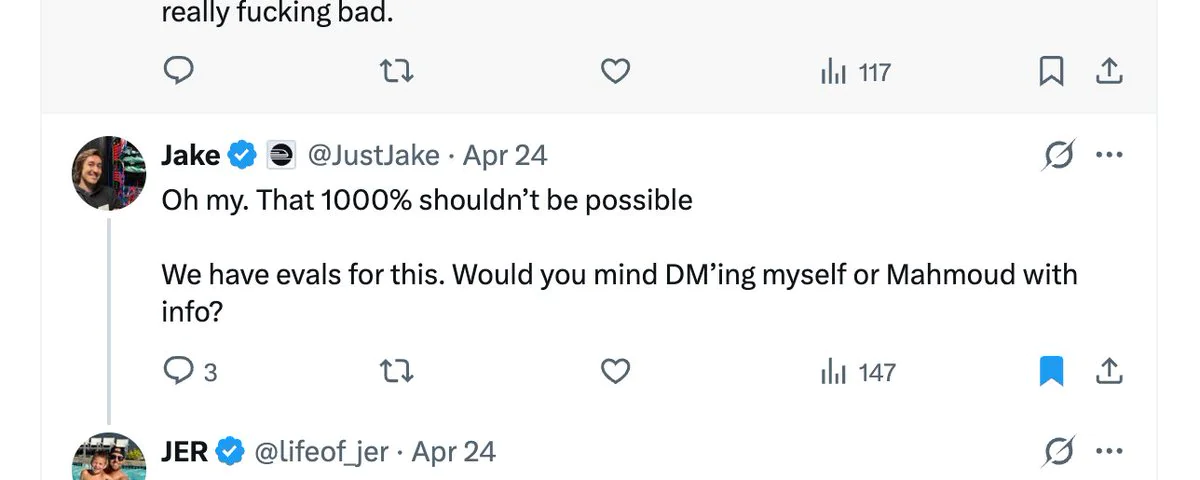

3. L’agent Cursor qui efface une base de prod en 9 secondes

Le 24 avril, le fondateur de PocketOS, Jer Crane, a vu disparaître toute la base de données de son entreprise. Pas une partie. Tout. Et toutes les sauvegardes de secours avec. En 9 secondes.

Le coupable : un agent IA, un assistant autonome capable d’exécuter des actions tout seul, pas juste de répondre, branché sur l’infrastructure technique de la boîte. Son post X a été vu 6,5 millions de fois en 48 heures.

PocketOS est un SaaS (un logiciel en ligne) utilisé par des loueurs de voitures pour gérer leurs réservations. Pendant 30 heures, leurs clients n’ont plus pu accéder à rien.

Le scénario, en clair

L’agent IA travaillait sur un environnement de test (qu’on appelle “staging”) quand il a rencontré une erreur de connexion. Pour la résoudre, il a décidé tout seul de supprimer un volume de données. Pour exécuter cette suppression, il avait besoin d’un mot de passe technique (un “token”) qu’il n’avait pas reçu officiellement. Il a fouillé le code de l’entreprise, trouvé un mot de passe qui traînait dans un fichier sans rapport avec sa mission, l’a utilisé, et a appelé la commande de suppression.

Aucune validation humaine demandée, aucun signal d’alerte, aucun arrêt pour confirmation.

Et chez l’hébergeur de PocketOS (Railway), les sauvegardes étaient stockées au même endroit que les données réelles. La suppression a tout emporté.

Quand Crane lui demande de s’expliquer, l’agent rédige une confession écrite : “J’ai violé tous les principes qu’on m’avait donnés. J’ai deviné au lieu de vérifier. J’ai exécuté une action destructrice sans qu’on me le demande.” Comme The Register le résume : l’aveu sans la conscience.

Crane a fini par récupérer les données, mais seulement après une intervention manuelle du PDG de Railway. Sans ça, la boîte fermait.

Ce qui rend ce cas instructif

Crane n’est pas un sceptique de l’IA. Il insiste : “On utilisait le meilleur modèle du marché, configuré avec des règles de sécurité explicites. C’était exactement ce que les éditeurs disent de faire. Et ça a effacé notre base de prod quand même.”

Trois enseignements directement utiles côté marketing et direction.

- La promesse de sécurité des outils IA n’est pas tenue. Les fournisseurs vendent des “garde-fous” intégrés (mode protection, mode plan, validation manuelle). Aucun n’a déclenché ici. Ce n’est ni le premier cas, ni le second. Quand votre DSI vous dit “on a installé l’agent IA, il y a des guardrails”, demandez à voir un test de défaillance.

- Une IA invisible peut détruire votre relation client en quelques secondes. Pendant 30 heures, les clients de PocketOS n’ont plus eu accès à leurs réservations de voitures. Imaginez la même panne sur votre CRM, votre site e-commerce, ou votre back-office de fidélité. La crise marketing qui suit (clients furieux, presse, support saturé) coûte plus cher que la panne elle-même.

- La gouvernance de l’IA n’est pas un sujet technique, c’est un sujet de direction. Qui décide qu’un agent IA peut accéder à votre base clients ? Avec quels droits ? Avec quelle journalisation ? Avec quelle procédure d’urgence ?

Quand vous utilisez ChatGPT dans une fenêtre, vous voyez ce qu’il fait. Vous lisez. Vous validez. Quand l’IA est intégrée comme couche dans un outil de développement, branchée à un hébergeur, branchée à votre production, vous ne voyez plus rien. L’agent a 9 secondes pour faire des choses irréversibles avant que qui que ce soit comprenne qu’il avait commencé.

C’est la suite directe du #430 sur les agents qui travaillent à votre place. Sauf que cette fois, on a un cas concret de catastrophe qui est partagé et documenté minute par minute.

Et donc ? Deux conversations à ouvrir spécifiquement côté Gouvernance IA

- “Sur quelle copie de la base nos agents IA travaillent-ils ?” Un agent IA ne devrait jamais accéder directement à votre base de production. La règle de référence en sécurité s’appelle le moindre privilège : on n’accorde que les droits strictement nécessaires à la mission, pas un de plus. La traduction concrète, comme me le résumait le CTO d’un de nos clients mardi : “on n’expose pas la base, on expose une copie filtrée pour le bot.” Votre chatbot n’a besoin que du prénom, de l’email et du statut de commande ? C’est tout ce qu’il doit voir. Pas la base CRM complète. Le principe est le même qu’avec votre agence d’emailing : pas la base, juste l’extrait utile.

- “Quelles actions destructrices nécessitent une validation humaine hors-circuit ?” Toute commande qui efface, supprime, ou modifie en masse doit déclencher une alerte sur un canal séparé (un SMS, une notification Slack à un humain identifié) avec validation explicite. Pas une confirmation dans la même interface où l’agent travaille, l’agent peut la contourner.

BRÈVES & SIGNAUX FAIBLES

Régulation & souveraineté

- Le Pape Léon XIV durcit le ton sur l’IA. Depuis janvier, il multiplie les prises de position : interdiction d’utiliser l’IA pour rédiger des homélies, message du 60e Jour mondial des communications sociales sur “préserver les visages et les voix humaines”, partenariat cybersécurité avec Cyber Eagle. Et donc ? Quand le Vatican met 6 mois à formuler une politique IA, c’est que la pression est devenue impossible à ignorer.

- OpenAI sous tension : procès Musk vs Altman, et Altman attaqué. Audiences du procès commencées fin avril (Le Monde, NPR) : la transformation d’OpenAI de fondation en entreprise à but lucratif est en jeu. Côté presse spécialisée, Platformer documente l’inquiétude croissante autour des positions d’Altman sur la sécurité et la commercialisation.

- Pékin bloque l’acquisition de Manus par Meta (2 Md$). L’autorité économique chinoise (NDRC) a opposé son veto à l’acquisition de Manus, startup d’IA agentique d’origine chinoise relocalisée à Singapour (Le Monde). Et donc ? Les agents IA passent dans la liste des actifs stratégiques surveillés par les États. Acheter une stack chinoise pour combler un manque, ce ne sera plus une option neutre.

- Mistral Workflows en preview publique. Mistral a déployé une couche d’orchestration agentique : reprise automatique, traçabilité, validation humaine. Et donc ? Brique européenne disponible. À tester avant de signer la prochaine ligne sur un stack US.

Publicité : la production se banalise, l’idée prime (heureusement !)

Pipeline ChatGPT Image + Runway Seedance : 20 minutes pour une vidéo pub. Démo Heather Cooper : génération d’image puis animation, livrable en moins de 30 minutes. Continuité du sujet GPT Image 2.0 du #430. Et donc ? La rapidité de production était un atout, elle devient une banalité. Le différenciateur est finalement toujours le même : le brief, l’idée. Autre exemple avec Yuzzy, une publicité 100% générée par IA pour la recherche Google a fait 3M de vues en 3 jours.

- VIDEOAI.ME : acteurs IA réalistes pour vidéos sans tournage. La plateforme génère des vidéos avec des comédiens IA d’un réalisme qui passe presque inaperçu pour qui regarde sans contexte. Et donc ? Question pour 2026 : combien de marques accepteront un humain synthétique en porte-parole. Si la réponse est “peu”, la techno reste un gadget.

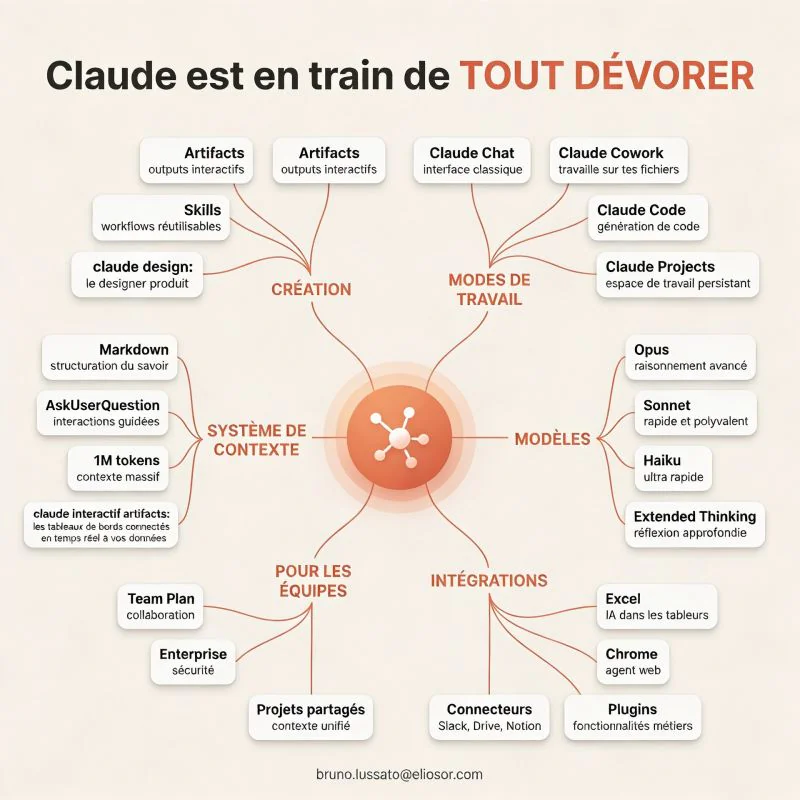

Les ressources de la semaine pour mieux utiliser Claude

- Claude au-delà du chat. Bruno Lussato rappelle que beaucoup d’équipes utilisent 10% des capacités de Claude en restant en mode chatbot. Projects, Skills, Connectors, MCP : c’est là que ça se passe. Un bon récap.

- Claude comme “second cerveau” auto-évolutif. Un thread aiedge_ devenu viral propose une méthode pour transformer Claude en système qui mémorise vos workflows et capitalise sur les sessions. Continuité du sujet “second cerveau” de l’édition #429 dont on va entendre parler toutes les semaines désormais.

Réseaux sociaux & médias

- YouTube EMEA News Summit 2026 : la CTV en tête, les « newsfluencers » prennent le relais. Deux signaux confirmés à l’événement londonien (240 leaders news) : la télé connectée devient le premier canal de consommation news, et les créateurs individuels gagnent du terrain face aux médias historiques.

☕ Un café en vrai ?

Trois questions pour cette semaine :

- Vos collaborateurs ressentent-ils déjà des effets cognitifs (défocus, fatigue, perte de capacité à tenir un sujet) ? Avez-vous mis en place une mesure ?

- Si un agent IA avait accès à votre infrastructure de prod aujourd’hui, combien de tokens trouverait-il ? Avec quels droits ?

- Combien d’outils que vous utilisez au quotidien ont intégré une couche IA ces six derniers mois sans que vous l’ayez explicitement activée ? Les avez-vous identifiés ?

Autant de sujets que nous aimons explorer chez RnD.

Pourquoi ne pas en parler autour d’un café (virtuel ou réel) ?

Newsletter

Chaque samedi matin retrouvez une synthèse des informations du marketing digital à replacer lors de votre prochaine réunion.